python爬取图片(正则、bs4、Xpath三种方法)_爬出图片-程序员宅基地

技术标签: ps4 爬虫 python xpath 正则表达式

本文给出爬取三个图片网站的案例,分别用到了正则表达式、bs4、Xpath三种解析方式。

目录:

案例一:正则表达式解析

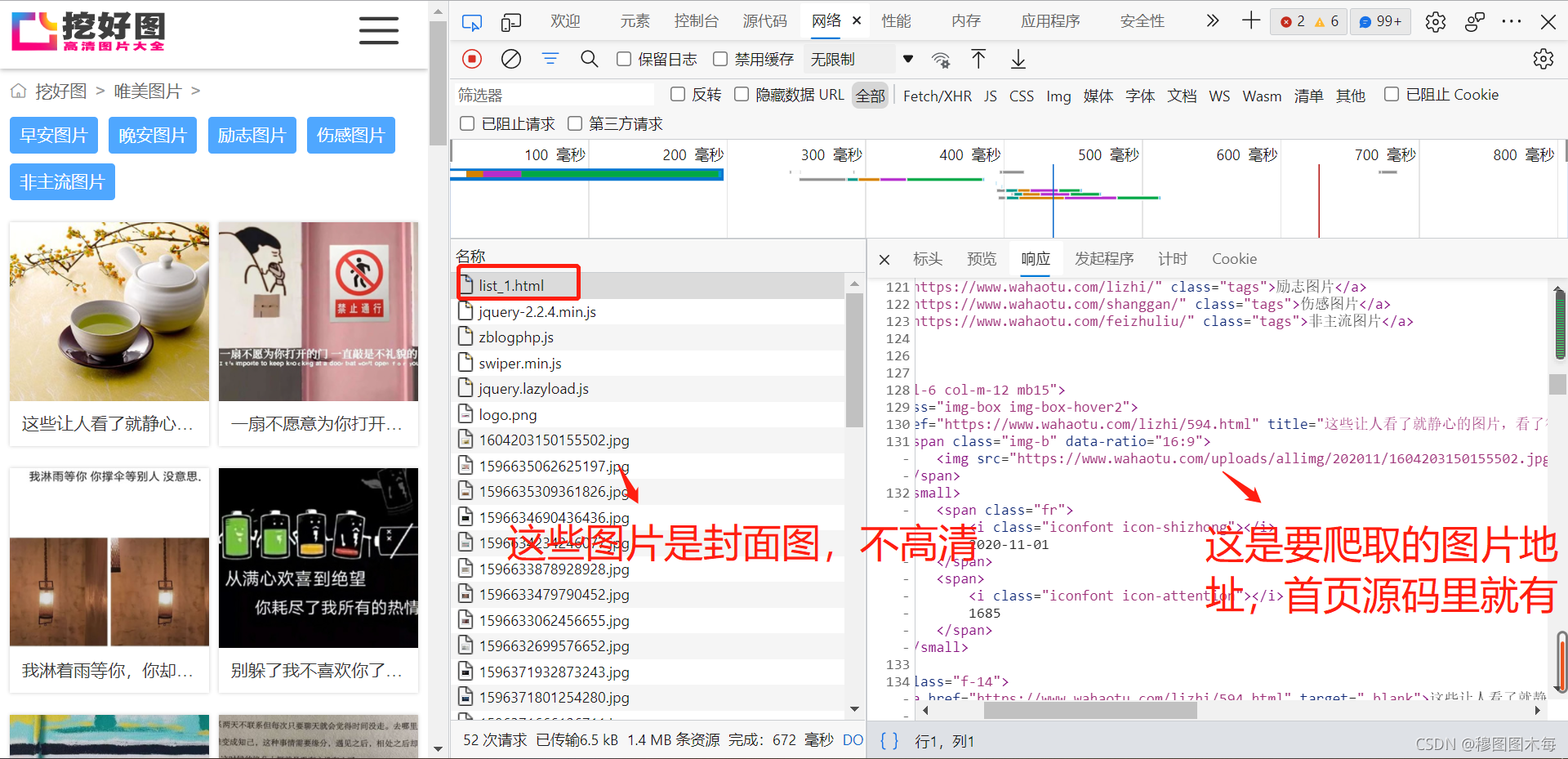

需求:爬取挖好图网”唯美分类“中的图片

详细代码如下:

# coding=gbk

import requests

import re

import os

#需求:爬取挖好图唯美图片

#网址:'https://www.wahaotu.com/weimei/list_1.html'

if __name__ == "__main__":

#创建一个文件夹,保存所有的图片

if not os.path.exists('./WeimeiPic'):

os.mkdir('./WeimeiPic')

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.54 Safari/537.36 Edg/95.0.1020.40'

}

url = 'https://www.wahaotu.com/weimei/list_%d.html'

for pageNum in range(1,3):

#对应页码的url

new_url = format(url%pageNum)

#使用通用爬虫对url对应的一整张页面进行爬取

page_text = requests.get(url=new_url,headers=headers).text

#使用聚焦爬虫将页面所有的图片进行解析、提取

obj = re.compile(r'<span class="img-box img-box-hover2">.*?<span class="img-b" data-ratio="16:9">'

r'<img src="(?P<website>.*?)" alt=".*?" class="lazy"></span>',re.S)

img_src_list = obj.finditer(page_text)

#img_src_list1 = obj.findall(page_text) #返回列表

for it in img_src_list:

url_pic = it.group('website')

img_data = requests.get(url=url_pic,headers=headers).content #返回二进制数据

#生成图片名称,迭代器不知道可以成功,列表肯定可以

img_name = url_pic.split('/')[-1]

imgPath = './WeimeiPic/'+img_name

with open(imgPath,'wb') as fp:

fp.write(img_data)

print(img_name,'下载成功!')运行结束后,图片保存到文件夹中:

案例二: bs4解析

需求:爬取优美图库中分类为“可爱头像”中的图片

主页面其实已经给出图片地址,没必要再进入到子页面。但当时没有注意,代码是按进入子页面抓取图片地址来写的。

这里只爬取了主页面第一页的部分图片,可以参照案例三修改得到所有页码的图片。

# coding=utf-8

"""

1.拿到主页面的源代码,然后提取到子页面的链接地址,href

2.通过href拿到子页面的内容,从子页面中找到图片的下载地址

3,下载图片

"""

import requests

from bs4 import BeautifulSoup

import time

import os

if __name__ == "__main__":

# 创建一个文件夹,保存所有的图片

if not os.path.exists('./TouXiangPic'):

os.mkdir('./TouXiangPic')

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.54 Safari/537.36 Edg/95.0.1020.40'

}

url = "https://www.umei.cc/touxiangtupian/keaitouxiang/"

resp = requests.get(url = url,headers=headers)

resp.encoding ='utf-8' #处理乱码

#把源代码交给BeautifulSoup

main_page = BeautifulSoup(resp.text,"html.parser")

alist = main_page.find("div",class_="TypeList").find_all('a') #把范围第一次缩小

#抓取列表第10到第15张图片

for a in alist[9:15]:

href = a['href']

#href = a.get('href') #通过get拿到属性的值

#拿到主页面的源代码

href_all = "https://www.umei.cc/"+ href

detail_page_resp = requests.get(url=href_all,headers=headers)

detail_page_resp.encoding = 'utf-8'

detail_page_text = detail_page_resp.text

#从子页面中拿到图片的下载途径

detail_page = BeautifulSoup(detail_page_text,'html.parser')

p = detail_page.find("p",align = "center")

img = p.find('img')

src = img['src']

#下载图片

img_resp = requests.get(url=src,headers=headers).content #这里拿到的是字节

img_name = src.split("/")[-1]

#‘wb’:表示以二进制写方式打开,只能写文件,如果文件不存在,创建该文件;如果文件已存在,则覆盖写。

imgPath = './TouXiangPic/' + img_name

with open(imgPath,mode = "wb") as fp:

fp.write(img_resp) #图片内容写入到文件

time.sleep(0.1)

print("=====over!========")运行得到的图片保存到TouXiangPic文件夹中:

案例三: Xpath解析

需求:爬取“我要个性网”中分类为“可爱头像”中的图片

源代码如下:

# -*- coding: utf-8 -*-

import requests

from lxml import etree

import os

if __name__ == "__main__":

#创建一个文件夹,保存所有的图片

if not os.path.exists('./KeaiPic'):

os.mkdir('./KeaiPic')

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.54 Safari/537.36 Edg/95.0.1020.40'

}

urlone = 'https://www.woyaogexing.com/tupian/keai/index.html'

urlother = 'https://www.woyaogexing.com/tupian/keai/index_%d.html'

pic_num = 0 #记录图片名称

for pageNum in range(1,3):

if pageNum == 1:

new_url = urlone

else:

new_url = format(urlother%pageNum)

#使用通用爬虫对url对应的一整张页面进行爬取

page_text = requests.get(url=new_url,headers=headers).text

#使用xpath将页面所有的图片进行解析、提取

tree = etree.HTML(page_text)

img_src_list = tree.xpath("//*[@id='main']/div[3]/div[1]/div[2]/div/a[1]/img/@src")

for it in img_src_list:

url_pic = "https:" + it

img_data = requests.get(url=url_pic,headers=headers).content #返回二进制数据

#生成图片名称,迭代器不知道是否可以成功,列表肯定可以

#img_name = url_pic.split('/')[-1]

#自己定义文件名

img_name = '图片{}{}'.format(str(pic_num),'.jpg')

imgPath = './KeaiPic/'+img_name

with open(imgPath,'wb') as fp:

fp.write(img_data)

pic_num = pic_num+1

print(img_name,'下载成功!')运行后图片保存到文件夹中,并按照下载顺序命名:

智能推荐

攻防世界_难度8_happy_puzzle_攻防世界困难模式攻略图文-程序员宅基地

文章浏览阅读645次。这个肯定是末尾的IDAT了,因为IDAT必须要满了才会开始一下个IDAT,这个明显就是末尾的IDAT了。,对应下面的create_head()代码。,对应下面的create_tail()代码。不要考虑爆破,我已经试了一下,太多情况了。题目来源:UNCTF。_攻防世界困难模式攻略图文

达梦数据库的导出(备份)、导入_达梦数据库导入导出-程序员宅基地

文章浏览阅读2.9k次,点赞3次,收藏10次。偶尔会用到,记录、分享。1. 数据库导出1.1 切换到dmdba用户su - dmdba1.2 进入达梦数据库安装路径的bin目录,执行导库操作 导出语句:./dexp cwy_init/[email protected]:5236 file=cwy_init.dmp log=cwy_init_exp.log 注释: cwy_init/init_123..._达梦数据库导入导出

js引入kindeditor富文本编辑器的使用_kindeditor.js-程序员宅基地

文章浏览阅读1.9k次。1. 在官网上下载KindEditor文件,可以删掉不需要要到的jsp,asp,asp.net和php文件夹。接着把文件夹放到项目文件目录下。2. 修改html文件,在页面引入js文件:<script type="text/javascript" src="./kindeditor/kindeditor-all.js"></script><script type="text/javascript" src="./kindeditor/lang/zh-CN.js"_kindeditor.js

STM32学习过程记录11——基于STM32G431CBU6硬件SPI+DMA的高效WS2812B控制方法-程序员宅基地

文章浏览阅读2.3k次,点赞6次,收藏14次。SPI的详情简介不必赘述。假设我们通过SPI发送0xAA,我们的数据线就会变为10101010,通过修改不同的内容,即可修改SPI中0和1的持续时间。比如0xF0即为前半周期为高电平,后半周期为低电平的状态。在SPI的通信模式中,CPHA配置会影响该实验,下图展示了不同采样位置的SPI时序图[1]。CPOL = 0,CPHA = 1:CLK空闲状态 = 低电平,数据在下降沿采样,并在上升沿移出CPOL = 0,CPHA = 0:CLK空闲状态 = 低电平,数据在上升沿采样,并在下降沿移出。_stm32g431cbu6

计算机网络-数据链路层_接收方收到链路层数据后,使用crc检验后,余数为0,说明链路层的传输时可靠传输-程序员宅基地

文章浏览阅读1.2k次,点赞2次,收藏8次。数据链路层习题自测问题1.数据链路(即逻辑链路)与链路(即物理链路)有何区别?“电路接通了”与”数据链路接通了”的区别何在?2.数据链路层中的链路控制包括哪些功能?试讨论数据链路层做成可靠的链路层有哪些优点和缺点。3.网络适配器的作用是什么?网络适配器工作在哪一层?4.数据链路层的三个基本问题(帧定界、透明传输和差错检测)为什么都必须加以解决?5.如果在数据链路层不进行帧定界,会发生什么问题?6.PPP协议的主要特点是什么?为什么PPP不使用帧的编号?PPP适用于什么情况?为什么PPP协议不_接收方收到链路层数据后,使用crc检验后,余数为0,说明链路层的传输时可靠传输

软件测试工程师移民加拿大_无证移民,未受过软件工程师的教育(第1部分)-程序员宅基地

文章浏览阅读587次。软件测试工程师移民加拿大 无证移民,未受过软件工程师的教育(第1部分) (Undocumented Immigrant With No Education to Software Engineer(Part 1))Before I start, I want you to please bear with me on the way I write, I have very little gen...

随便推点

Thinkpad X250 secure boot failed 启动失败问题解决_安装完系统提示secureboot failure-程序员宅基地

文章浏览阅读304次。Thinkpad X250笔记本电脑,装的是FreeBSD,进入BIOS修改虚拟化配置(其后可能是误设置了安全开机),保存退出后系统无法启动,显示:secure boot failed ,把自己惊出一身冷汗,因为这台笔记本刚好还没开始做备份.....根据错误提示,到bios里面去找相关配置,在Security里面找到了Secure Boot选项,发现果然被设置为Enabled,将其修改为Disabled ,再开机,终于正常启动了。_安装完系统提示secureboot failure

C++如何做字符串分割(5种方法)_c++ 字符串分割-程序员宅基地

文章浏览阅读10w+次,点赞93次,收藏352次。1、用strtok函数进行字符串分割原型: char *strtok(char *str, const char *delim);功能:分解字符串为一组字符串。参数说明:str为要分解的字符串,delim为分隔符字符串。返回值:从str开头开始的一个个被分割的串。当没有被分割的串时则返回NULL。其它:strtok函数线程不安全,可以使用strtok_r替代。示例://借助strtok实现split#include <string.h>#include <stdio.h&_c++ 字符串分割

2013第四届蓝桥杯 C/C++本科A组 真题答案解析_2013年第四届c a组蓝桥杯省赛真题解答-程序员宅基地

文章浏览阅读2.3k次。1 .高斯日记 大数学家高斯有个好习惯:无论如何都要记日记。他的日记有个与众不同的地方,他从不注明年月日,而是用一个整数代替,比如:4210后来人们知道,那个整数就是日期,它表示那一天是高斯出生后的第几天。这或许也是个好习惯,它时时刻刻提醒着主人:日子又过去一天,还有多少时光可以用于浪费呢?高斯出生于:1777年4月30日。在高斯发现的一个重要定理的日记_2013年第四届c a组蓝桥杯省赛真题解答

基于供需算法优化的核极限学习机(KELM)分类算法-程序员宅基地

文章浏览阅读851次,点赞17次,收藏22次。摘要:本文利用供需算法对核极限学习机(KELM)进行优化,并用于分类。

metasploitable2渗透测试_metasploitable2怎么进入-程序员宅基地

文章浏览阅读1.1k次。一、系统弱密码登录1、在kali上执行命令行telnet 192.168.26.1292、Login和password都输入msfadmin3、登录成功,进入系统4、测试如下:二、MySQL弱密码登录:1、在kali上执行mysql –h 192.168.26.129 –u root2、登录成功,进入MySQL系统3、测试效果:三、PostgreSQL弱密码登录1、在Kali上执行psql -h 192.168.26.129 –U post..._metasploitable2怎么进入

Python学习之路:从入门到精通的指南_python人工智能开发从入门到精通pdf-程序员宅基地

文章浏览阅读257次。本文将为初学者提供Python学习的详细指南,从Python的历史、基础语法和数据类型到面向对象编程、模块和库的使用。通过本文,您将能够掌握Python编程的核心概念,为今后的编程学习和实践打下坚实基础。_python人工智能开发从入门到精通pdf