”Spark环境搭建“ 的搜索结果

环境搭建 Spark On Yarn Hadoop环境 设置CentOS进程数和文件数(重启生效) [root@CentOS ~]# vi /etc/security/limits.conf * soft nofile 204800 * hard nofile 204800 * soft nproc 204800 * hard nproc 204800 ...

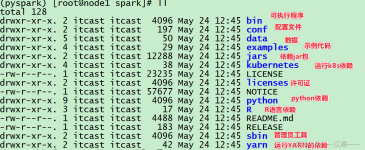

本文讲解如何在Linux系统中安装Spark并配置Spark环境,以及Spark的基本使用方法。

Spark CoreCreate Repository ...能够完成 Spark 的集群搭建和安装 通过入门案例理解 Spark 的编程模型 RDD 了解 RDD 的常见使用 Table of Contents 1. Spark 概述 1.1. Spark是什么...

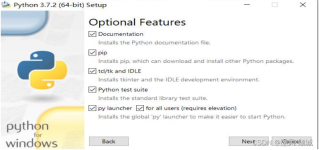

spark学习 spark开发环境搭建spark学习 spark开发环境搭建spark学习 spark开发环境搭建spark学习 spark开发环境搭建

Spark环境搭建教程

标签: spark

Spark环境搭建 Spark Local本地模式 Standalone-独立集群 Standalone-HA Spark-On-Yarn Spark 是一种基于内存的快速、通用、可扩展的大数据分析计算引擎

linux端的hadoop和spark环境搭建: Linux环境设置 1设置固定IP(静态) 2新增oracle用户 3设置oracle用户拥有root用户的命令 4设置网络映射 5关闭防火墙 vim /etc/sysconfig/network-scripts/ifcfg-eth0 DEVICE=eth0...

本文主要介绍Spark相关环境搭建

一、Java安装1、安装目录准备在安装这些包之前在家目录下创建一个app的目录,app目录中创建一个tmp目录:[root@hadoop-master ~]#mkdir -p app/tmp2、解压JDK上传JDK1.8版本jdk-8u74-linux-x64.tar.gz到linux上,...

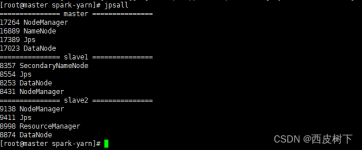

这篇博客,Alice为大家带来的是Spark集群环境搭建之——standalone集群模式。 文章目录集群角色介绍集群规划修改配置并分发启动和停止查看web界面测试 集群角色介绍 Spark是基于内存计算的大数据并行计算框架,...

Spark环境搭建-Linux

本篇博客,Alice为大家带来关于如何搭建Spark的on yarn集群模式的教程。 文章目录准备工作cluster模式client模式[了解]两种模式的区别 官方文档: http://spark.apache.org/docs/latest/running-on-yarn.html 准备...

【代码】Spark环境搭建与使用。

本篇博客,Alice为大家带来的是Spark的HA高可用环境搭建的教程。 原理 Spark Standalone集群是Master-Slaves架构的集群模式,和大部分的Master-Slaves结构集群一样,存在着Master单点故障的问题。 如何解决这个单点...

出现这个问题的原因是我们在windows上模拟开发环境,但并没有真正的搭建hadoop和spark 解决办法:当然也并不需要我们真的去搭建hadoop 下载这个winutils:链接:https://pan.baidu.com/s/12o-QubOX2B5RdFYYXUG4Ag ...

在Standalon模式中,Spark集群由Master节点和Worker节点构成,使用内置的Standalon框架进行资源管理。Spark程序通过与Master节点交互,申请所需资源。Worker节点负责具体的Executor的启动运行。 Standadlon模式的...

推荐文章

- python入门(13)异常与文件_except filenotfounderror:-程序员宅基地

- Android面试攻略_详细了解在当今的社会里android工程师应具备什么的技能?并能详细说说自己的见解。-程序员宅基地

- Zendframework 1.6整合Smarty_setting private or protected class member is not a-程序员宅基地

- Qt-装饰者模式_qt装饰模式-程序员宅基地

- 新开普掌上校园服务管理平台service.action RCE漏洞复现 [附POC]-程序员宅基地

- 基于 Milvus 的音频检索系统-程序员宅基地

- 331、基于51单片机智能红外遥控暖风机温度无线蓝牙远程控制系统设计(程序+原理图+配套资料等)_红外感应暖风机自动控制系统设计-程序员宅基地

- Android自定义圆角矩形图片ImageView_android 矩形圆角imageview-程序员宅基地

- 又见回文 字符串-程序员宅基地

- switch的参数可以是什么类型?_switch的参数有哪些-程序员宅基地