”反向传播“ 的搜索结果

反向传播

中文版 神经网络反向传播算法 的详细分析!

反向传播——机器学习

标签: 人工智能

今天小编就为大家分享一篇pytorch中的自定义反向传播,求导实例,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧

最大值池化层梯度反向传播1

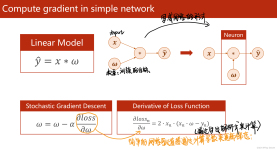

假设学习率为ε=0.1,经计算可得此时的w=0.71,b=0.14,y=1.205,L=0.082。如图所示,x经过一个线性方程得到y,其中y=wx+b,我们用最小二乘法作为优化的损失函数。...这种从后向前计算参数梯度的方法:反向传播算法。

神经网络反向传播图解,使用图像介绍了反向传播的过程,公式清楚,逻辑明确。 反向传播(英语:Backpropagation,缩写为BP)是“误差反向传播”的简称,是一种与最优化方法(如梯度下降法)结合使用的,用来训练...

1.版本:matlab2019a,不会运行可私信 2.领域:基础教程 3.内容:Matlab实现反向传播学习的多层感知器 (MLP) 神经网络算法 4.适合人群:本科,硕士等教研学习使用

# 2.1 反向传播算法原理 反向传播算法是一种用于训练神经网络的算法,它通过计算损失函数相对于网络权重的梯度来更新网络权重。其基本原理如下: **2.1.1 反向传播算法的数学推导** 设神经网络的损失函数为 L,第...

深度学习是一种机器学习技术,它通过构建多层的神经网络模型来学习数据的复杂模式。在深度学习中,梯度下降算法、链式法则、反向传播算法和激活函数是四个核心概念,它们相互关联,共同工作以训练神经网络模型。

数学推导CNN的BP, 究极详细

反向传播(Backpropagation)是指在神经网络中使用梯度下降等优化算法进行模型训练时,通过计算损失函数对模型参数的梯度,然后反向传播这些梯度从输出层到输入层,以更新模型参数的过程。(Forward Propagation):...

训练是使用带有弹性梯度下降、动量反向传播和学习率降低选项的反向传播算法完成的。 当均方误差 (MSE) 达到零或达到预定义的最大时期数时,训练停止。 有关更多详细信息和结果讨论,请访问我的博客文章: ...

反向传播:代码演示篇

标签: h1 反向传播

反向传播:代码演示篇概述正文1、从零开始2、借助深度学习框架 概述 本节继上一节反向传播:公式推导篇的代码演示,本节将从零开始演示反向传播训练参数的整个过程,除此之外还将使用TF2.0来进行快速求导作为拓展...

反向传播算法:训练神经网络的秘密武器 1.背景介绍 1.1 神经网络的兴起 近年来,人工智能领域取得了令人瞩目的进展,其中神经网络在计算机视觉、自然语言处理、语音识别等诸多领域展现出了强大的能力。神经网络的兴起,...

基于matlab实现的自适应学习速率反向传播网络.rar

本文将从反向传播的本质、反向传播的原理、反向传播的案例三个方面,详细介绍反向传播(Back Propagation)。

需要注意的是,反向传播并不是一个单一的算法,而是一种通用的思想,可以适用于各种神经网络结构和优化算法。反向传播(Backpropagation)是一种用于训练神经网络的算法,主要用于计算网络中每个参数对于损失函数的...

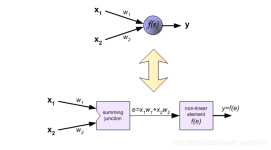

神经网络的前向传播和反向传播推导 x1x_{1}x1和x2x_{2}x2表示输入 wijw_{ij}wij表示权重 bijb_{ij}bij表示偏置 σi\sigma_{i}σi表示激活函数,这里使用sigmoid激活函数 outoutout表示输出 yyy表示真实值...

在线深度学习中提出的对冲反向传播(HBP)的实现:动态学习深度神经网络 IJCAI-ECAI-18 预印本: : 。 现在,该存储库是LIBOL的一部分,将不再更新。 请检查以获取ODL和其他在线学习软件的最新更新。

如图我们在最下边输入两个维度的值进入神经网络:0.05、0.1 ,经过两个隐藏层(每层两个神经元),每个神经元有两个值,左边为输入值,右边是经过激活函数后的输出值;这种算法基于梯度下降法来优化误差函数,利用了...

虽然用过caffe,用过tensorflow,用过mtcnn、knn、dnn、svm、yolo、ssd、s3fd、faceboxes,但还是个AI小白,神经网络对于我来说就是个典型的黑盒子,想研究一下,不知从哪开始,听说BP算法具有划时代的意义----机器...

在正向传播过程中,输入数据通过神经网络的各个层,逐层进行计算和变换,最终得到神经网络的输出结果。具体来说,正向传播包括以下步骤:1. 输入数据传入输入层:将输入数据传入神经网络的输入层。2. 加权求和:输入...

通过自编写的代码实现了LSTM的反向传播,与网文《LSTM反向传播详解Part1》《LSTM反向传播详解Part2》《LSTM反向传播详解(完结篇)Part3/3代码实现》配套

使用反向传播算法的多层神经网络的 MATLAB 实现。 数据使用:MNIST( http://yann.lecun.com/exdb/mnist/ )

反向传播算法通过链式求导法则,计算损失函数关于每个节点输出的偏导数(即梯度),然后逐层向前传播这些梯度信息,以更新每层的权重和偏置项。然后,反向传播算法根据这个方向,逐层计算每个节点的残差值,并根据...

推荐文章

- 日常Java练习题(每天进步一点点系列)_callable的call方法返回值-程序员宅基地

- 已解决Using TensorFlow backend.-程序员宅基地

- ring0下的 fs:[124]_nsfs124-程序员宅基地

- 高德地图打包后不能使用,高德导航View不显示,高德地图导航组件黑屏的问题;_amap.amapwx打包成安卓后无法使用-程序员宅基地

- HTML5与微信开发(2)-视频播放事件及API属性_微信开发者工具视频快进-程序员宅基地

- JedisConnectionException Connection Reset_jedisconnectionexception: java.net.socketexception-程序员宅基地

- Lua5.3版GC机制理解_lua5.3 gc-程序员宅基地

- 手机能打开的表白代码_能远程打开,各种手机电脑进行监控操作,最新黑科技...-程序员宅基地

- 成功Ubuntu18.04 ROS melodic安装Cartograhper+Ceres1.13.0,以及错误总结_ros18.04 安装ca-程序员宅基地

- Harbor2.2.1配置(trivy扫描器、镜像签名)_init error: db error: failed to download vulnerabi-程序员宅基地