”学习力“ 的搜索结果

哈佛学习力.docx

标签: 哈佛学习力总结

你想拥有哈佛学生的学习力吗,掌握里面的方法和技巧吧,理解里面的每一点,你的生活将从此发生巨变,你也会拥有更好的生活,学会更多更多的东西,没有什么是你难以抵达的,这将成为引领你一生的文库,如若你阅读之后...

中国科学院香港创新院AI与机器人中心的刘宏斌研究员团队提出了一个名为DaFoEs的新视觉-触觉数据集,用于深度神经模型的训练,该数据集包含了不同环境的变量。为了减少单一数据集的偏差,研究者们开发了一个管道,...

五维学习力+成为知识焦虑时代的深度学习者.pdf

学习愉悦化方法包括穿插喜欢的任务、制定合理计划、换环境减少任务数量、注重学习过程。文章强调峰终定律对学习体验的影响,提出了实用的方法来提高学习愉悦度。这些方法有助于提高搜索引擎抓取,体现了对学习心理和...

/* 版权声明:可以任意转载,转载时请标明文章原始出处和作者信息 .*/ 张俊林 (...

如何在工作中保持自己的学习能力

员工个人能力提升对团队战斗力至关重要。通过设定成长目标和采用“7-2-1”法则进行学习,激发员工学习意愿。管理者应给予压力、方向和自主学习空间,促进员工个人能力提升。同时,相信员工能力的差异性和团队能力的...

请注意,顺序操作会妨碍并行计算,而任意的序列位置组合之间的路径越短,则能更轻松地学习序列中的远距离依赖关系。总而言之,卷积神经网络和自注意力都拥有并行计算的优势, 而且自注意力的最大路径长度最短。但是...

为此,与其只使用单独一个注意力汇聚, 我们可以用独立学习得到的组不同的 线性投影(Linear Projections)来变换查询、键和值。然后,这组变换后的查询、键和值将并行地送到注意力汇聚中。最后,将这个注意力汇聚的...

注意力机制(Attention Mechanism)是一种在计算机科学和机器学习中常用的技术,可以使模型在处理序列数据时更加准确和有效。在传统的神经网络中,每个神经元的输出只依赖于前一层的所有神经元的输出,而在注意力...

自主性的与非自主性的注意力提示解释了人类的注意力的方式, 下面来看看如何通过这两种注意力提示, 用神经网络来设计注意力机制的框架,首先,考虑一个相对简单的状况, 即只使用非自主性提示。如下图所示,可以...

具体来说,1964年提出的Nadaraya-Watson核回归模型是一个简单但完整的例子,可以用于演示具有注意力机制的机器学习。简单起见,考虑下面这个回归问题: 给定的成对的数据集{(x1y1x2y2⋯xnyn)}

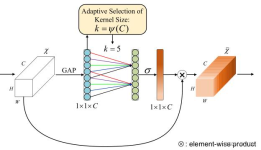

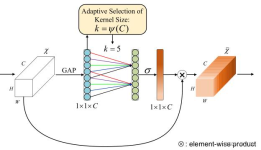

在各种计算机视觉任务中,通道或空间注意力机制在产生更清晰的特征表示方面的显著有效性得到了证明。然而,通过通道降维来建模跨通道关系可能会给提取深度视觉表示带来副作用。提出了一种新的高效的多尺度注意力(EMA...

在处理词元序列时,循环神经网络是逐个的重复地处理词元的,而自注意力则因为并行计算而放弃了顺序操作。为了使用序列的顺序信息,通过在输入表示中添加位置编码(Positional Encoding)来注入绝对的或相对的位置...

在为给定文本序列生成手写的挑战中, Graves设计了一种可微注意力模型, 将文本字符与更长的笔迹对齐, 其中对齐方式仅向一个方向移动。在预测词元时,如果不是所有输入词元都相关,模型将仅对齐(或参与)输入序列...

标题:5分钟克服拖延症的方法 总结:本文介绍了3种克服拖延症的方法:5分钟起步法,留下偷懒的资格和空间,以及替代拖延法。这些方法能帮助提高学习和工作效率,克服拖延心理,适用于提高生产力和时间管理。

本周我们继续来聊面试的问题,这次要谈一个比较困难的问题,那就是判定一个人的学习能力。 为什么要判断学习能力 一个人的学习能力是个一比较抽象的概念,这个能力之所以重要主要是由于当前技术领域的更新速度实在是...

推荐文章

- Android RIL框架分析-程序员宅基地

- Python编程基础:第六节 math包的基础使用Math Functions_ps math function-程序员宅基地

- canal异常 Could not find first log file name in binary log index file_canal could not find first log file name in binary-程序员宅基地

- 【练习】生成10个1到20之间的不重复的随机数并降序输出-程序员宅基地

- linux系统扩展名大全,Linux系统文件扩展名学习-程序员宅基地

- WPF TabControl 滚动选项卡_wpf 使用tabcontrol如何给切换的页面增加滚动条-程序员宅基地

- Apache Jmeter常用插件下载及安装及软硬件性能指标_jmeter插件下载-程序员宅基地

- SpringBoot 2.X整合Mybatis_springboot2.1.5整合mybatis不需要配置mapper-locations-程序员宅基地

- ios刷android8.0,颤抖吧 iOS, Android 8.0正式发布!-程序员宅基地

- 【halcon】C# halcon 内存暴增_halcon 读二维码占内存-程序员宅基地