”梯度“ 的搜索结果

主要是解决长序列梯度计算中幂指数大小的问题(长序列意味着高阶幂指数计算,容易导致梯度极大或极小),可以通过门控设计来直接减少幂指数大小(直接干掉大阶数,替换为合理数值),从而缓解梯度消失或梯度爆炸问题...

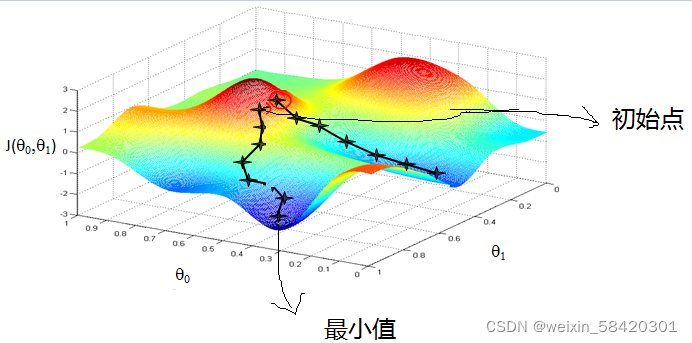

c++实现的线性回归梯度下降法。线性回归的梯度下降:其实就是将梯度下降算法和代价函数相结合,最重要的是梯度下降法的导数部分。

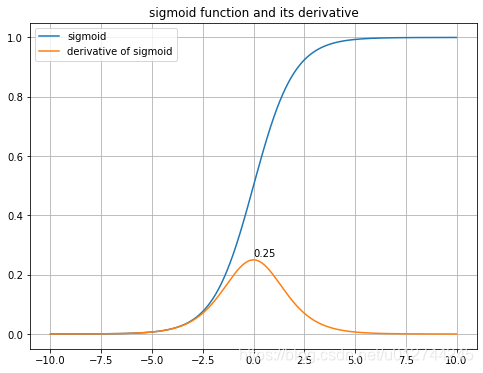

你真的了解Pytorch中梯度的计算原理吗?这篇文章主要涉及Pytorch中梯度计算的知识,包括什么是叶子向量,梯度反向传播原理,参数优化过程的详细解释。

梯度下降法matlab程序,需要手动输入参数梯度下降法matlab程序,需要手动输入参数梯度下降法matlab程序,需要手动输入参数

全梯度下降算法(FGD)、随机梯度下降算法(SGD)、随机平均梯度下降算法(SAGD)、小批量梯度下降算法(Mini-batch gradient descent,MGD)梯度下降优化算法,动量法、Adagrad、Adadelta、RMSProp、Adam

梯度方向是,步长设为常数Δ,这时就会发现,如果用在梯度较大的时候,离最优解比较远,W的更新比较快;在这儿,我们再作个形象的类比,如果把这个走法类比为力,那么完整的三要素就是步长(走多少)、方向、出发点...

递归神经网络存在的问题3.1 梯度爆炸与梯度消失是怎么样产生的4. LSTM 1. 简述语言模型 现在的语言模型使用很广泛。最常见的应用之一,就是各种输入法的预测输入。比如,当用户输入一段文字之后,输入法会自动的...

单幅图像的平均梯度值计算 MATLAB源程序 【更新】2009-04-15 15:59说明:该程序的作用是计算输入图像img的平均梯度值AVEGRAD 平均梯度值可以衡量图像细节反差表达的能力,是图形融合结果的一个评价算子之一

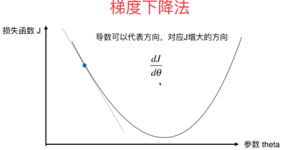

梯度下降法(Gradient Descent)是一种常用的优化算法,用于在训练机器学习模型时最小化损失函数(即误差)。 在机器学习中,我们通常将问题描述成最小化一个损失函数的过程,其中损失函数是关于模型参数的函数。...

梯度下降法 梯度下降算法原理讲解——机器学习.pdf 梯度下降算法原理讲解——机器学习.pdf 梯度下降算法原理讲解——机器学习.pdf 梯度下降算法原理讲解——机器学习.pdf 梯度下降算法原理讲解——机器学习.pdf 梯度...

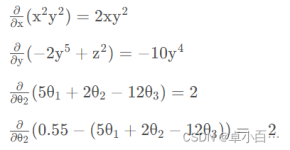

用c++写的共轭梯度法程序,有求在某点的梯度的函数,和偏导数

AI,ML,gradient descent,paper,matlab

计算图像每个点的梯度,包括横向梯度、纵向梯度

斯坦福大学机器学习公开课第二课监督学习的应用梯度下降法的程序练习

1、什么是梯度 在微积分中,对多元函数的参数求∂偏导,把求得的各个参数的偏导数以向量形式写出来即为梯度。 例如对于函数f(x,y),分别对x,y求偏导,求得的梯度向量就是 (∂f/∂x, ∂f/∂y)^T,简称 grad f(x,y),...

共轭梯度法的简单直观理解

标签: 线性代数

梯度下降、随机梯度下降、批量梯度下降 方法之间性能优缺点的对比.zip

但每次迭代中只使用一个样本计算梯度,因此每次迭代的梯度都是有噪声的,毕竟不是所有样本的均值,所以下降(下山)会走一点弯路,但总体因为总的迭代次数很多,所以随机梯度下降法最终会收敛到最优解 ,还是划得来...

梯度下降算法代码及详细解释(非常易懂)Matlab代码,有详细图文解释,适合小白,全面介绍算法原理和公式推导

,得到的这个tensor永远不需要计算其梯度,不具有梯度grad,即使之后重新将它的requires_grad置为true,它也不会具有梯度grad。detach()函数,返回一个新的tensor,是从当前计算图中分离下来的,但是仍指向原变量的...

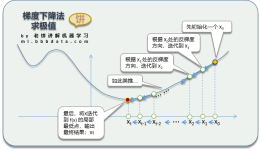

梯度下降法是一种用于最小化函数的迭代优化算法。其基本思想是通过计算函数的梯度 (导数),找到函数的最小值点。在梯度下降法中,参数(或变量)沿着负梯度的方向进行更新,以降低函数值。选择初始点: 选择一个初始...

推荐文章

- IDEA修改SVN地址-程序员宅基地

- 欧拉图和哈密顿图_哈密顿通路度为偶数-程序员宅基地

- Linux下SVN安装配置和使用中遇到的问题-程序员宅基地

- 【算法】设计算法求所有强连通分量的完整代码(kosaraju算法)_kosaraju算法代码-程序员宅基地

- 程序员的自我评价_程序员自我评价-程序员宅基地

- vue的vue-resource和axios介绍_vue-resuorce-程序员宅基地

- MySQL笔记复习(实例 全)_在 goods_name 列上加普通索引-程序员宅基地

- 敏捷软件开发宣言-程序员宅基地

- Android实现通用的ActivityGroup(效果类似Android微博客户端主界面)-程序员宅基地

- git:一、GIT介绍+安装+全局配置+基础操作_请确保本地完成了 git 的全局配置-程序员宅基地