梯度算子,图像的梯度函数即为函数灰度变化的速率

”梯度“ 的搜索结果

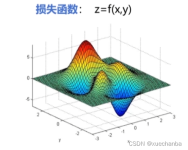

1.梯度下降法是求解最优化问题最常用的算法之一2.只要没有到达梯度为0的点,则函数值会沿着序列xk递减,最终会收敛到梯度为0的点,这就是梯度下降法3.初始值设定与学习率设置是影响梯度下降...

随机梯度下降SGD stochastic gradient descent

梯度下降法(Gradient descent)或最速下降法(steepest descent)是求解无约束最优化问题的一种常用方法。假设fx)在R上具有一阶连续偏导数的函数。要求解的无约束最优化问题是。其本质是一个迭代的方法,选择初始值...

全波形反演最速下降法,共轭梯度发matlab程序。仅供参考

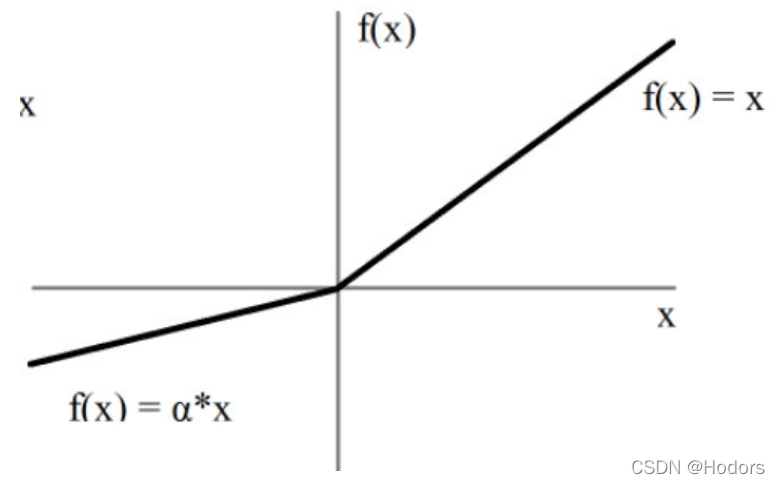

一、RNN基本结构 1、隐层状态sts_tst st=σ(Uxt+Wst−1+b)s_t=\sigma(Ux_t+Ws_{t-1}+b)st=σ(Uxt+Wst−1+b) σ\sigmaσ()是激活函数,通常选用Tanh、ReLU。 2、输出状态oto_tot ot=g(Vst+c)o_t=g(Vs_t+c)...

因为是CV出身的,转了推荐...梯度下降也是一种优化算法, 通过迭代的方式寻找使模型目标函数达到最小值时的最优参数, 当目标函数为凸函数的时候,梯度下降的解是全局最优解,但在一般情况下,梯度下降无法保证全局最优

在机器学习中,基于基本的梯度下降法发展了两种梯度下降方法,分别为随机梯度下降法和批量梯度下降法。比如逻辑回归可以用梯度下降进行优化,因为这两个算法的损失函数都是严格意义上的凸函数,即存在全局唯一极小值...

Policy Gradient策略梯度算法原理

梯度下降算法的正确步骤Title: What is the Gradient Descent Algorithm and its working. 标题:什么是梯度下降算法及其工作原理。 Gradient descent is a type of machine learning algorithm that helps us in ...

自然梯度算法和变步长优选函数不完整自然梯度算法。

1、梯度剪裁的原因 2、梯度裁剪的使用 2.1、固定阈值剪裁 2.2、根据参数的范数来衡量的 3、梯度裁剪的使用位置 梯度剪裁,一种避免梯度爆炸的方式。 1、梯度剪裁的原因 神经网络是通过梯度下降来学习的。而...

1 引言 梯度下降法(Gradient ...由梯度下降法衍生了许多其他算法,如次梯度下降法,近端梯度下降法,随机梯度下降法,回溯梯度发,动量加速梯度法等等。本文只介绍最基础的梯度下降法原理和理论分析,与此同时,通过

对矩阵(向量)求梯度梯度是个矩阵(向量)对一个标量求梯度梯度是个标量我还有一个感受就是,作为一个之前惯用C/C++程序员,python变量数据类型的这种灵活性真的让我非常、非常的不适应,我多次因此而蒙圈了,呜。...

可以通过梯度下降寻找一维非线性函数最优值

产生梯度不稳定的根本原因是前面层上的梯度是来自后面层上梯度的乘积。当存在过多的层时,就会出现梯度不稳定场景,比如梯度消失和梯度爆炸。所以梯度消失和梯度爆炸属于梯度不稳定的范畴。 (2)梯度消失和梯度爆炸...

什么是梯度惩罚?为什么它比渐变裁剪更好?如何实施梯度惩罚?在提起GAN对抗网络中,就不能避免Wasserstein距离的概念,本篇为系列读物,目的是揭示围绕Wasserstein-GAN建模的一些重要概念进行探讨。

本文通过数据试验分析梯度消失和梯度爆炸的原因并分析各种常用解决方案的效果。 梯度消失/爆炸是困扰深度神经网络的大问题,ResNet和BatchNormalization的原理在网上已有不少文章介绍,但是从文章的跟帖评论中可以...

前面转了篇梯度下降算法的文章,脑子里对梯度的印象又不太清楚了,以下内容转自百度百科 在向量微积分中,标量场的梯度是一个向量场。标量场中某一点上的梯度指向标量场增长最快的方向,梯度的长度是这个...

最速下降梯度法matlab程序 最速下降梯度法matlab程序

如何理解梯度爆炸和梯度消失

标签: 人工智能

在显卡内存不够的情况下,可以通过梯度累积的方式,来扩大batchsize。 因为pytorch中,反向传播之后,梯度是不清零的,因此要实现梯度累积,比较简单 不使用梯度累积的情况下,训练代码: for i, (input_id, ...

推荐文章

- YOLO V8车辆行人识别_yolov8 无法识别路边行人-程序员宅基地

- jpa mysql分页_Spring Boot之JPA分页-程序员宅基地

- win10打印图片中间空白以及选择打印机预览重启_win10更新后打印图片中间空白-程序员宅基地

- 【加密】SHA256加盐加密_sha256随机盐加密-程序员宅基地

- cordys 启动流程_cordys服务重启-程序员宅基地

- net中 DLL、GAC-程序员宅基地

- (一看就会)Visual Studio设置字体大小_visual studio怎么调整字体大小-程序员宅基地

- Linux中如何读写硬盘(或Virtual Disk)上指定物理扇区_dd写入确定扇区-程序员宅基地

- python【力扣LeetCode算法题库】面试题 17.16- 按摩师(DP)_一个有名的讲师,预约一小时为单位,每次预约服务之间要有休息时间,给定一个预约请-程序员宅基地

- 进制的转换技巧_10111100b转换为十进制-程序员宅基地