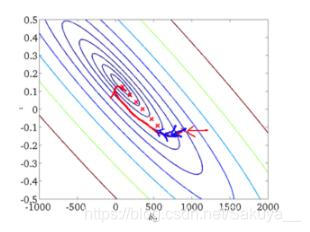

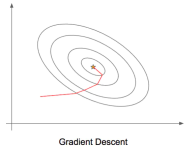

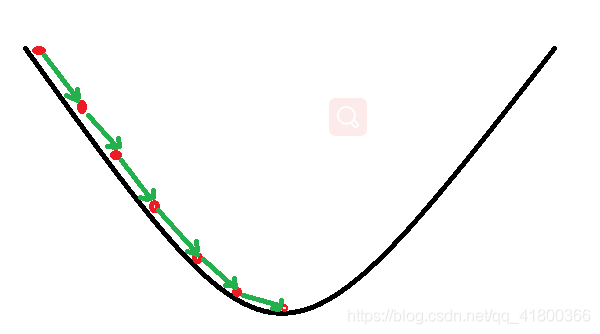

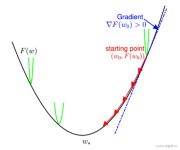

梯度下降法 梯度下降法简介 梯度下降法,又称最速下降法,是一个一阶最优化算法,迭代法的一种,可以用于求解最小二乘问题(线性和非线性都可以) 基本思想 可用下山举例说明,将小人看作J(ω),即表示目标函数,...

”梯度下降“ 的搜索结果

随机梯度下降SGD stochastic gradient descent

代码梯度下降法 Optimal_method Implement some optimal method in Matlab, for a optimal method class in Beijing Institute of Technology 为北京理工大学自动化学院,最优化方法写的Matlab代码 These files are ...

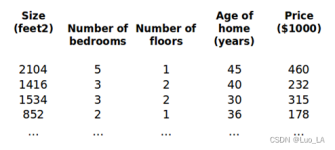

个人公众号:经管人学数据分析基本介绍梯度下降法(gradient descent),又名最速下降法(steepest descent)是求解无约束最优化问题最常用的方法,它是一种迭代方法,每一步主要的操作是求解目标函数的梯度向量,将当前...

BAT算法工程师为你深入详细地讲解梯度下降法,带你轻松入门机器学习!

这是用于使用软边界模型和次梯度下降优化的 2 类问题的支持向量机代码。

基于Python的梯度下降法实现基于Python的梯度下降法实现基于Python的梯度下降法实现基于Python的梯度下降法实现 基于Python的梯度下降法实现基于Python的梯度下降法实现 基于Python的梯度下降法实现 基于Python的...

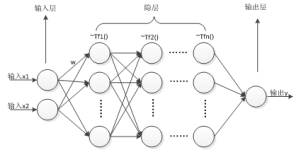

神经网络的梯度下降算法代码实现

小批量随机梯度下降 在每一次迭代中,梯度下降使用整个训练数据集来计算梯度,因此它有时也被称为批量梯度下降(batch gradient descent)。 随机梯度下降在每次迭代中只随机采样一个样本来计算梯度。 可以在每轮...

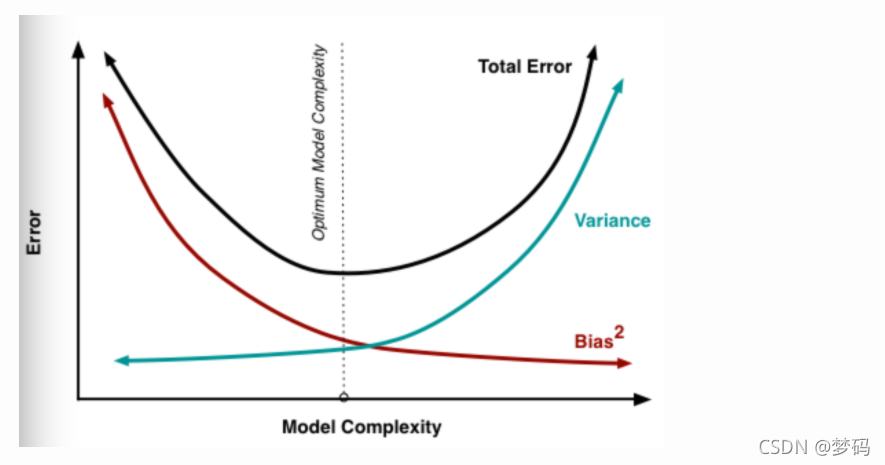

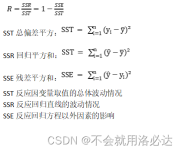

引言 李航老师在《统计学习方法》中将机器学习的三要素总结为:模型、策略和算法。其大致含义如下: 模型:其实就是机器学习训练的过程中所要学习的条件概率分布或者决策函数。 ...策略:就是使用一种什么样的评价,...

梯度下降法,共轭梯度下降法,随机梯度下降法 Posted on2015-11-18 | Inmath | 在机器学习领域,优化方法一直是一个很重要的领域,最常见的就是利用目标函数的导数通过多次迭代来求解无约束最优化问题,那么什么...

一个matlab的m文件,使用梯度下降法进行数据训练实现数据分类(线性可分问题)

神经网络的组成单元——神经元,神经元也叫做感知机。 在机器学习算法中,有时候需要对原始的模型构建损失函数,...而在求解机器学习参数的优化算法中,使用较多的就是基于梯度下降的优化算法(Gradient Descent, GD)。

矩阵分解——梯度下降法场景相关函数梯度下降求解过拟合代码 场景 当然是推荐系统了。 假设有四部电影,有五个人看了其中的几部,对其打了分数(实际情况是一部电影有四个侧重方向,也就是因子): 我们...

比较不同的梯度下降算法为批处理,随机和微型批处理梯度下降算法编写代码。 针对人为生成的数据对这些算法进行了测试,然后比较了它们的相对性能。

梯度提升与梯度下降梯度提升 梯度提升

简单描述下梯度下降法的算法步骤

梯度下降和随机梯度下降的区别

标签: 梯度下降

在学习机器学习的过程中梯度下降这个词出现的频率很高,在运用的过程中不能很好的理解算法的意思,于是从网路上查找了一些资料。 一.介绍 梯度下降法(gradient descent)是求解无约束最优化问题的一种常用方法,...

推荐文章

- 网络结构搜索 (NAS: Network Architecture Search)-程序员宅基地

- 运营技能:从公众号引流到小程序(关注自动回复小程序消息)_公众号回复小程序-程序员宅基地

- TensorFlow 可视化显示 运行过程_pycharm tensorflow 运行状态-程序员宅基地

- C++STL中map内存彻底释放方法_c++ map 手动释放-程序员宅基地

- Qt小例子学习75 - 把QGraphicsItem 保存到文本然后读出来显示_qt qgraphicspathitem 保存 读取saveitem-程序员宅基地

- 详解十三款运维监控工具_听云 监控宝-程序员宅基地

- 本科、硕士和博士有何区别?-程序员宅基地

- 如何对webbrowser和IE编程(一)_vb webbrowser internetexplorer-程序员宅基地

- 传智教育与华为开发者联盟、天津经开区人社局达成鸿蒙生态人才共建合作_鸿蒙生态 天津-程序员宅基地

- 微信小程序点击实现隐藏和点击实现显示_微信小程序点击显示隐藏的-程序员宅基地