基于梯度下降法的线性回归模型预测房价,进行多元线性回归,其中包括一套关于房价预测的数据和基于numpy和pandas基础库的源代码

”梯度下降“ 的搜索结果

针对无波前探测自适应光学提出一种基于正交模式扰动梯度下降(OP_GD)算法的控制技术.通过与串行扰动梯度下降算法和随机并行梯度下降(SPGD)算法对比,分析了该算法的可行性和收敛速度.在此基础上,采用液晶空间光调制器...

针对梯度下降在线性回归中的应用,使用python 代码手写一个梯度下降的函数,这样对梯度下降会有一个更好的了解

这个例子是为在研究生... 这个例子演示了如何使用梯度下降法来解决一个简单的无约束优化问题。 采用大步长会导致算法不稳定,但小步长会导致计算效率低下。 可以在此处找到相应的视频: https://youtu.be/qLpOWteWmjs

梯度下降法,梯度下降法原理和步骤,matlab源码 (1)

本文实例为大家分享了python实现梯度下降算法的具体代码,供大家参考,具体内容如下 简介 本文使用python实现了梯度下降算法,支持y = Wx+b的线性回归 目前支持批量梯度算法和随机梯度下降算法(bs=1) 也支持输入...

但每次迭代中只使用一个样本计算梯度,因此每次迭代的梯度都是有噪声的,毕竟不是所有样本的均值,所以下降(下山)会走一点弯路,但总体因为总的迭代次数很多,所以随机梯度下降法最终会收敛到最优解 ,还是划得来...

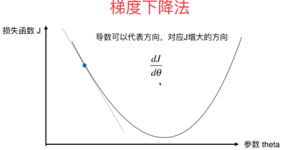

梯度下降法是最早最简单,也是最为常用的最优化方法。梯度下降法实现简单,当目标函数是凸函数时,梯度下降法的解是全局解。一般情况下,其解不保证是全局最优解,梯度下降法的速度也未必是最快的。梯度下降法的优化...

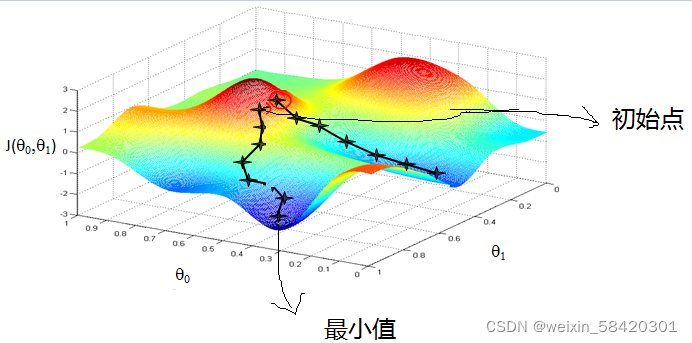

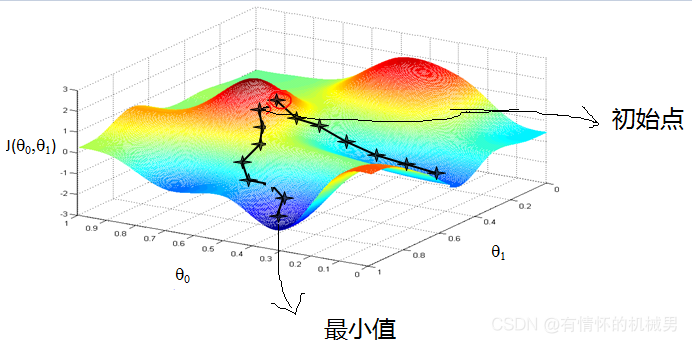

使用梯度下降法求多元函数的系数并与最小二乘法进行比较梯度下降法的原理和概念梯度下降法求解多元函数的极值梯度下降法求解多元函数的系数最小二乘法求解多元函数的系数比较和总结 梯度下降法的原理和概念 偏导数:...

梯度下降 与knn算法代码

标签: 随机梯度下降

python写的 梯度下降 与knn算法代码 !anaconda的安装环境,供大家学习用!

kNN_梯度下降算法_

标签: 梯度下降算法

梯度下降算法是机器学习中的最基础的算法之一,原理简单,适合初学者学习。

使用神经网络进行样本训练,要实现随机梯度下降算法。这里我根据麦子学院彭亮老师的讲解,总结如下,(神经网络的结构在另一篇博客中已经定义): def SGD(self, training_data, epochs, mini_batch_size, eta, ...

梯度方向是,步长设为常数Δ,这时就会发现,如果用在梯度较大的时候,离最优解比较远,W的更新比较快;在这儿,我们再作个形象的类比,如果把这个走法类比为力,那么完整的三要素就是步长(走多少)、方向、出发点...

梯度下降法求函数极值

标签: 求极值 梯度下降

利用梯度下降法求函数极小值,或稍作修改用梯度上升法求极大值,附带测试函数

梯度下降法对于参数多的回归方程仍然适用,但并不是每次都能达到最优解,神经网络也需要梯度下降法来解决 标准方程法适用于参数少的回归方程,但是时间复杂度较高 正文: 首先来看一下梯度下降法的代码 import numpy...

主要为大家详细介绍了python实现随机梯度下降法,具有一定的参考价值,感兴趣的小伙伴们可以参考一下

BP神经网络梯度下降法,可预测输出,预测结果图形,预测误差图形

主要为大家详细介绍了python+numpy+matplotalib实现梯度下降法,具有一定的参考价值,感兴趣的小伙伴们可以参考一下

梯度下降法(Gradient Descent)是一种常用的优化算法,用于在训练机器学习模型时最小化损失函数(即误差)。 在机器学习中,我们通常将问题描述成最小化一个损失函数的过程,其中损失函数是关于模型参数的函数。...

梯度下降、随机梯度下降、批量梯度下降 方法之间性能优缺点的对比.zip

基于梯度下降的参数辨识代码,分析了定常和时变系统在不同学习率调整规则下的辨识结果。在MATLAB 的AppDesigner设计工具上制作了参数辨识面板。

常见梯度下降算法latex版本的ppt,主要描述了梯度下降变体BGD,SGD,MBGD,梯度优化算法Momentum、Nesterov accelerated gradient、AdaGrad、RMSProp、Adadelta、Adam,以及如何去选择和使用他们

上一篇文章讲述了梯度下降法的数学思想,趁热打铁,这篇博客笔者将使用梯度下降法完成多元线性回归,话不多说,直接开始。 我们假设我们的目标函数是长这样的: import numpy as np import pandas as pd # 读入...

机器学习监督学习算法,梯度下降、批梯度下降

Fortune算法、Lloyd算法和梯度下降的Julia实现应用

深入理解梯度下降法:从原理到实践

标签: 神经网络

梯度下降法(Gradient Descent)是机器学习和深度学习中最基本、最重要的优化算法之一。它被用于训练神经网络、拟合模型参数和解决各种问题。本博客将深入探讨梯度下降法的原理、不同变种、超参数调优和实际应用,...

推荐文章

- kali安装ARL灯塔过程_kali装arl灯塔-程序员宅基地

- FPGA-LCD基础驱动_fpga lcd cnt-程序员宅基地

- Python - 使用python-opencv裁剪原视频为与视频高同宽的视频_opencv去掉视频上半部分-程序员宅基地

- Flutter 升级 2.0 填坑指导,带你原地起飞_because flutter_styled_toast >=2.0.0 depends on fl-程序员宅基地

- FastDFS 集群搭建_fastdfs在线扩容-程序员宅基地

- Java把一个对象转换成xml数据_java 对象怎么封装才能转成list格式的xml-程序员宅基地

- java 渐进式_javaSpringBoot带前后端渐进式开发企业级博客系统-程序员宅基地

- 使用图像直方图方式搜索相似图片_基于直方图的以图搜图-程序员宅基地

- HTML、CSS和JS如何变成页面的-程序员宅基地

- DuiLib属性_c++ duilib vscrollbar设置-程序员宅基地