梯度下降法(Gradient descent )是一个一阶最优化算法,通常也称为最陡下降法 ,要使用梯度下降法找到一个函数的局部极小值 ,必须向函数上当前点对应梯度(或者是近似梯度)的反方向的规定步长距离点进行迭代搜索...

”梯度下降优化算法“ 的搜索结果

大多数数据科学算法是优化问题。而这方面最常使用的算法是梯度下降。 或许梯度下降听起来很玄,但读完这篇文章之后,你对它的感觉大概会改变。 这里用住宅价格预测问题作为例子,并附有Matlab程序源文件供大家学习

深度学习的优化方法-梯度下降算法

原始梯度下降算法 delta = - learning_rate * gradient theta += delta 导致的问题是特别陡峭的地方和特别平缓的地方采用同样的learning_rate,如果learning_rate太大很容易在陡峭的地方一个大幅度的迭代会跨过最...

【翻译自 : Gradient Descent With ... 梯度下降是一种优化算法,遵循目标函数的负梯度以定位函数的最小值。 梯度下降的一个限制是,如果目标函数返回嘈杂的梯度,则它可能会卡在平坦的区域中或反弹。动量是...

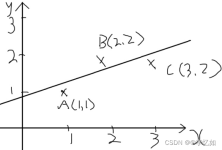

一、线性回归问题 回归最简单的定义是,给出一个点集D,用一个函数去拟合这个点集,并且使得点集与拟合函数间的误差最小,如果这个函数曲线是一条直线,那就被称为线性回归,如果曲线是一条二次曲线,就被称为...

梯度下降法(Gradient descent)是一个一阶最优化算法。 要使用梯度下降法找到一个函数的局部极小值,必须向函数上当前点对应梯度(或者是近似梯度)的反方向的规定步长距离点进行迭代搜索。如果相反地向梯度正方向...

常用的梯度下降算法一般是Batch Gradient Descent,Mini-batch Gradient Descent和Stochastic Gradient Descent。 1. Batch Gradient Descent 1)优点: 在训练过程中,使用固定的学习率,不必担心学习率...

本文主要介绍随机梯度下降法

优化算法和梯度下降法

标签: 优化算法 梯度下降

这个文件里面主要讲述了优化算法和梯度下降法

陷入局部最优并不是神经网络的问题,在一个高维空间中做梯度下降,很难收敛到局部最优,因为局部最小值要求函数在所有维度上都是局部最小值。若一个维度收敛到局部最小值的概率是0.5,则n维度收敛到局部最小值的概率...

在介绍Adam之前首先介绍一下momentum和RMSprop优化算法。 一、momentum 1、指数加权平均数 指数加权平均数不仅考虑了当前数值也涵盖了以前的数据对现在的影响。 解释指数加权平均值名称的由来: 指数加权平均值的...

梯度下降综述

梯度下降算法详细解析及代码实现

标签: 函数优化

如有冒犯,还望谅解! 梯度下降的场景假设 梯度 ...本文将从一个下山的场景开始,先提出梯度下降算法的基本思想,进而从数学上解释梯度下降算法的原理,最后实现一个简单的梯度下降算法的实例!...

Adam

# -*- coding: utf-8 -*- import numpy as np import scipy as spy from scipy.sparse import csc_matrix import matplotlib.pyplot as plt import time #用来计算运行时间 #=======模拟数据====================== ...

- 无约束最优化问题:梯度下降法、牛顿法、拟牛顿法; - 有约束最优化问题:拉格朗日乘数法。 一、梯度下降法 1、算法简介 梯度下降法是最早最简单,也是最为常用的最优化方法。梯度下降法实现简单,当...

大部分的机器学习模型里有直接或者间接地使用了梯度下降的算法。虽然不同的梯度下降算法在具体的实现细节上会稍有不同,但是主要的思想是大致一样的。梯度下降并不会涉及到太多太复杂的数学知识,只要稍微了解过微...

梯度下降算法及其改进方法详解1. 前提1.1 成本函数设计完神经网络结构之后,接下来就要设计神经网络的学习算法。假设向量X\textbf{X}为神经网络的输入向量,向量Y\textbf{Y}为神经网络的输出向量,向量A\textbf{A}为...

介绍两种算法前,先定义两个坐标系。导航坐标系(参考坐标系)n,选取东北天右手直角坐标系作为导航坐标系n、载体坐标系(机体坐标系)b,选取右手直角坐标系定义:四轴向右为X正方向,向前为Y轴正方向,向上为Z轴正...

1)Batch gradient descent(批量梯度下降) 在整个数据集上 每更新一次权重,要遍历所有的样本,由于样本集过大,无法保存在内存中,无法线上更新模型。对于损失函数的凸曲面,可以收敛到全局最小值,对于非...

批量梯度下降、随机梯度下降、小批量梯度下降的python实现 之前写线性回归那一块内容的时候,发过手写二元线性回归梯度下降的博,由于基于方程的写法过于复杂,于是有了这一篇基于矩阵的梯度下降实现~

推荐文章

- javafx预览PDF_javafx pdf-程序员宅基地

- ipv4与ipv6访问_纯ipv4访问纯ipv6-程序员宅基地

- css强制换行-程序员宅基地

- 链霉亲和素修饰的CdSe–ZnS量子点-程序员宅基地

- 饿了么4年 + 阿里2年:研发路上的一些总结与思考-程序员宅基地

- vue的sync语法糖的使用(组件父子传值)_sync传值-程序员宅基地

- 最大流最小割_网络最大流量与割的容量的关系-程序员宅基地

- queryString模块_querystring模块安装-程序员宅基地

- 安卓电量检测工具Battery Historian的使用记录_battery-historian 电量测试-程序员宅基地

- 基于QPSK的载波同步和定时同步性能仿真,包括Costas环的gardner环_qpsk符号同步-程序员宅基地