随机梯度下降法 (Stochastic Gradient Descent,SGD) 是一种梯度下降法的变种,用于优化损失函数并更新模型参数。与传统的梯度下降法不同,SGD每次只使用一个样本来计算梯度和更新参数,而不是使用整个数据集。这种...

”随机梯度下降SGD“ 的搜索结果

logistic随机梯度下降问题.docx

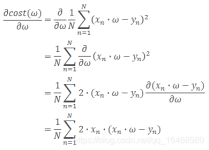

backpropagation backpropagation解决的核心问题损失函数c与w,b求偏导,(c为cost(w,b)) 整体来说,分两步 1.z=w*a’+b 2.a=sigmoid(z) 其中,a’表示上一层的输出值,a表示当前该层的输出值 1,输入x,正向的更新一...

它每次迭代时从训练数据中随机选择一个小批量(mini-batch)的样本来计算梯度,然后使用梯度的相反方向更新模型参数。:SGD通常需要大量的迭代来达到收敛,因此可能需要设置一个合适的训练轮数或使用早停策略来确定...

机器学习算法demo合集(普通最小二乘法,决策树(Iris鸢尾花数据集),KNN(mnist手写数字数据集),朴素贝叶斯分类西瓜数据集,trec06c数据集垃圾邮件分类(spam),逻辑斯蒂回归,随机梯度下降SGD与全梯度下降的...

随机梯度下降SGD算法理解

标签: SGD

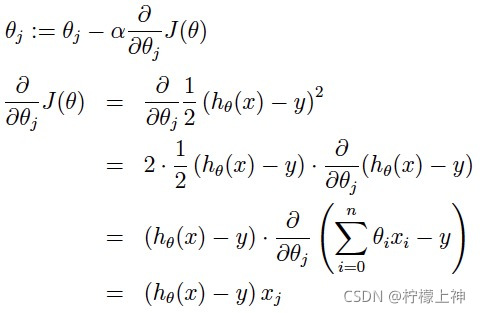

随机梯度下降算法(Stochastic gradient descent,SGD)在神经网络模型训练中,是一种很常见的优化算法。这种算法是基于梯度下降算法产生的,所以要理解随机梯度下降算法,必须要对梯度下降算法有一个全面的理解。 ...

在深度学习中,模型的...随机梯度下降(Stochastic Gradient Descent,简称SGD)是一种在深度学习中常用的优化算法,用于最小化损失函数,即在机器学习中找到模型的参数,使得模型预测的损失(例如分类错误率)最小。

随机梯度下降SGD stochastic gradient descent

随机梯度下降(SGD)是一种用于优化机器学习模型的非常流行的算法。它特别适用于大规模数据集,因为它在每次迭代中仅使用一小部分数据。这使得SGD比批量梯度下降(使用整个数据集的梯度下降)更快、更高效。接下来,...

4.批量大小: 在随机梯度下降(SGD)和小批量梯度下降(Mini-batch GD)中,批量大小的选择也可能影响收敛性。3.损失函数的形状: 损失函数的形状对于梯度下降的性能也很重要。梯度下降法的收敛取决于多个因素,包括...

机器学习 | Python随机梯度下降SGD

梯度下降是常用的优化方法之一,而批量梯度下降(BGD)和随机梯度下降(SGD)是其中的两种典型代表。本章将介绍这两种方法的比较,帮助读者更好地理解它们之间的异同点,以便在实际应用中进行选择。 在训练模型时,...

尽管反向传播和梯度下降已经在深度学习中取得了巨大的成功,但是它们也面临着一些挑战。例如,梯度消失和梯度爆炸问题,这使得深度网络的训练变得非常困难;另外,梯度下降的收敛速度通常比较慢,尤其是在遇到非凸...

这个术语通常指的是(或最大化)的函数。在机器学习和优化中,目标函数可以包括损失函数以及正则化项...在机器学习和深度学习中,,而梯度是一种用于指导参数更新的重要工具。(Stochastic Gradient Descent)的缩写。

为求得超平面,感知机导入了基于误分类的损失函数,利用梯度下降法对损失函数进行最优化求解。如果训练数据集是线性可分的,则感知机一定能求得分离超平面。如果是非线性可分的数据,则无法获得超平面。感知机具有...

SGD随机梯度下降Matlab代码

其中,**随机梯度下降法(Stochastic Gradient Descent, SGD)**是梯度下降法的一种变体,在实际应用中表现出色,广泛应用于深度学习、大规模优化等领域。本文将详细介绍SGD算法的原理和应用,帮助读者深入理解这一重要的...

最近面试有要求手撕SGD,这里顺便就把梯度下降、随机梯度下降、批次梯度下降给写出来了。1.求梯度时注意label[i]和pred[i]不要搞反,否则会导致模型发散。2.如果跑了几千个epoch,还是没有收敛,可能是学习率太小了...

随机梯度下降(Stochastic Gradient Descent SGD) 之前讨论了经典的随机梯度下降算法:Gradient Descent 我们可以将其用于参数化学习,优化分类器的权重矩阵 W 。但是这种经典的梯度下降算法在大的数据集上...

BGD vs SGDBGD vs SGD名词解释功能快捷键合理的创建标题,有助于目录的生成如何改变文本的样式插入链接与图片如何插入一段漂亮的代码片生成一个适合你的列表创建一个表格设定内容居中、居左、居右SmartyPants创建一...

回顾梯度下降流程 #1 初始化 θ\thetaθ #2 求 gradient ...随机梯度下降 SGD 随机:Stochastic 梯度:Gradient 下降:Descent 每一步下降用随机抽取的样本 优点:速度快 缺点:精度下降 for i = 1 to m...

随机梯度下降算法SGD 参考:为什么说随机最速下降法 (SGD) 是一个很好的方法? 假如我们要优化一个函数f(x)f(x)f(x) ,即找到它的最小值,常用的方法叫做 Gradient Descent (GD),也就是最速下降法。说起来很简单, ...

随机梯度下降算法 先解释一些概念。 1.什么是梯度下降 我们先从一张图来直观解释这个过程。 如上图假设这样一个场景:一个人被困在山上,需要从山上下来,但此时山上的浓雾很大,导致可视度很低。因此,下山...

概括地来说,随机梯度下降(Stochastic Gradient Descent,SGD)是一种迭代优化算法,用于最小化代价函数J(θ)。该算法在每次迭代时随机选择一个训练样本,并利用该样本对模型参数θ进行更新,然后重复这个过程多次...

pytorch 使用随机梯度下降优化变量。

理解随机梯度下降,首先要知道梯度下降法,故先介绍梯度下降法: 梯度下降法 大多数机器学习或者深度学习算法都涉及某种形式的优化。优化本质指的是改变以最小化或最大化某个函数的任务。我们通常以最小化指代...

推荐文章

- yolov3系列(四)-keras-yolo3-实时眼睛鼻子嘴巴监测系统_眼睛 嘴巴 yolo-程序员宅基地

- C++类型支持之std::decltype-程序员宅基地

- GB/T28181国标视频监控平台TINYGBS支持4G执法记录仪接入大型可视指挥调度平台-程序员宅基地

- 毕设项目 基于wifi的室内定位算法设计与实现-程序员宅基地

- 【.Net】C# 根据绝对路径获取 带后缀文件名、后缀名、文件名、不带文件名的文件路径...-程序员宅基地

- c语言比用delay更好的延时,PIC单片机C语言程序设计(15)-程序员宅基地

- 微型计算机的细思维特征,详细版2014计算机基础期末考试大纲-程序员宅基地

- org.eclipse.wst.common.component_org/eclipse/wst/common/componentcore/resources/ivi-程序员宅基地

- 数据结构乐智教学百度云_数据结构 百度网盘分享-程序员宅基地

- Arcade 绘制全屏-程序员宅基地