Flink的sink实战之三:cassandra3_flink cassandra-程序员宅基地

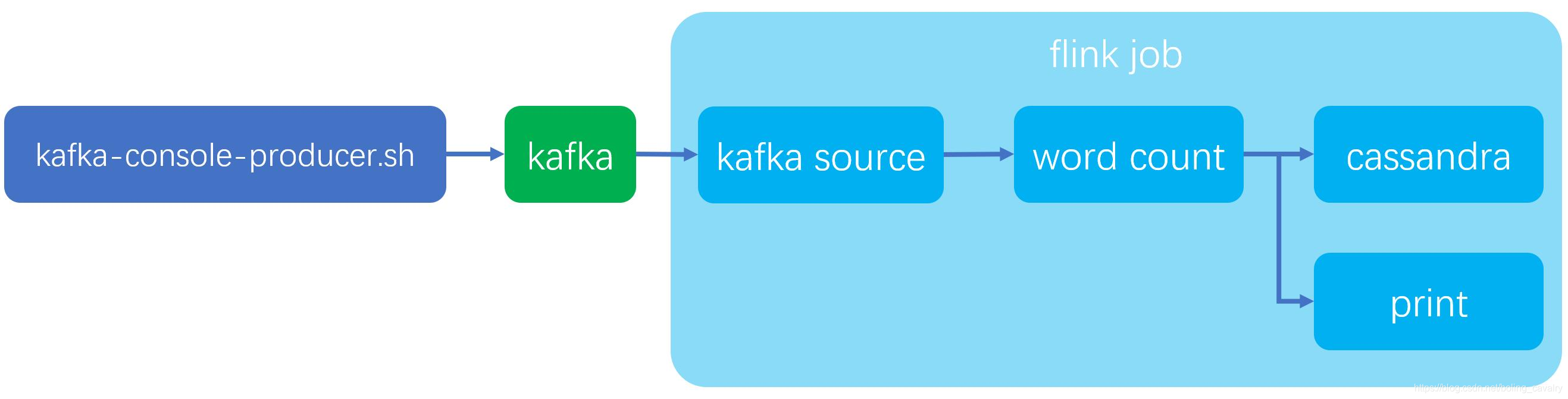

本文是《Flink的sink实战》系列的第三篇,主要内容是体验Flink官方的cassandra connector,整个实战如下图所示,我们先从kafka获取字符串,再执行wordcount操作,然后将结果同时打印和写入cassandra:

全系列链接

软件版本

本次实战的软件版本信息如下:

- cassandra:3.11.6

- kafka:2.4.0(scala:2.12)

- jdk:1.8.0_191

- flink:1.9.2

- maven:3.6.0

- flink所在操作系统:CentOS Linux release 7.7.1908

- cassandra所在操作系统:CentOS Linux release 7.7.1908

- IDEA:2018.3.5 (Ultimate Edition)

关于cassandra

本次用到的cassandra是三台集群部署的集群,搭建方式请参考《ansible快速部署cassandra3集群》

准备cassandra的keyspace和表

先创建keyspace和table:

- cqlsh登录cassandra:

cqlsh 192.168.133.168

- 创建keyspace(3副本):

CREATE KEYSPACE IF NOT EXISTS example

WITH replication = {

'class': 'SimpleStrategy', 'replication_factor': '3'};

- 建表:

CREATE TABLE IF NOT EXISTS example.wordcount (

word text,

count bigint,

PRIMARY KEY(word)

);

准备kafka的topic

- 启动kafka服务;

- 创建名为test001的topic,参考命令如下:

./kafka-topics.sh \

--create \

--bootstrap-server 127.0.0.1:9092 \

--replication-factor 1 \

--partitions 1 \

--topic test001

- 进入发送消息的会话模式,参考命令如下:

./kafka-console-producer.sh \

--broker-list kafka:9092 \

--topic test001

- 在会话模式下,输入任意字符串然后回车,都会将字符串消息发送到broker;

源码下载

如果您不想写代码,整个系列的源码可在GitHub下载到,地址和链接信息如下表所示(https://github.com/zq2599/blog_demos):

| 名称 | 链接 | 备注 |

|---|---|---|

| 项目主页 | https://github.com/zq2599/blog_demos | 该项目在GitHub上的主页 |

| git仓库地址(https) | https://github.com/zq2599/blog_demos.git | 该项目源码的仓库地址,https协议 |

| git仓库地址(ssh) | [email protected]:zq2599/blog_demos.git | 该项目源码的仓库地址,ssh协议 |

这个git项目中有多个文件夹,本章的应用在flinksinkdemo文件夹下,如下图红框所示:

两种写入cassandra的方式

flink官方的connector支持两种方式写入cassandra:

- Tuple类型写入:将Tuple对象的字段对齐到指定的SQL的参数中;

- POJO类型写入:通过DataStax,将POJO对象对应到注解配置的表和字段中;

接下来分别使用这两种方式;

开发(Tuple写入)

- 《Flink的sink实战之二:kafka》中创建了flinksinkdemo工程,在此继续使用;

- 在pom.xml中增加casandra的connector依赖:

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-cassandra_2.11</artifactId>

<version>1.10.0</version>

</dependency>

- 另外还要添加flink-streaming-scala依赖,否则编译CassandraSink.addSink这段代码会失败:

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-scala_${scala.binary.version}</artifactId>

<version>${flink.version}</version>

<scope>provided</scope>

</dependency>

- 新增CassandraTuple2Sink.java,这就是Job类,里面从kafka获取字符串消息,然后转成Tuple2类型的数据集写入cassandra,写入的关键点是Tuple内容和指定SQL中的参数的匹配:

package com.bolingcavalry.addsink;

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.functions.sink.PrintSinkFunction;

import org.apache.flink.streaming.api.windowing.time.Time;

import org.apache.flink.streaming.connectors.cassandra.CassandraSink;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaConsumer;

import org.apache.flink.util.Collector;

import java.util.Properties;

public class CassandraTuple2Sink {

public static void main(String[] args) throws Exception {

final StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

//设置并行度

env.setParallelism(1);

//连接kafka用到的属性对象

Properties properties = new Properties();

//broker地址

properties.setProperty("bootstrap.servers", "192.168.50.43:9092");

//zookeeper地址

properties.setProperty("zookeeper.connect", "192.168.50.43:2181");

//消费者的groupId

properties.setProperty("group.id", "flink-connector");

//实例化Consumer类

FlinkKafkaConsumer<String> flinkKafkaConsumer = new FlinkKafkaConsumer<>(

"test001",

new SimpleStringSchema(),

properties

);

//指定从最新位置开始消费,相当于放弃历史消息

flinkKafkaConsumer.setStartFromLatest();

//通过addSource方法得到DataSource

DataStream<String> dataStream = env.addSource(flinkKafkaConsumer);

DataStream<Tuple2<String, Long>> result = dataStream

.flatMap(new FlatMapFunction<String, Tuple2<String, Long>>() {

@Override

public void flatMap(String value, Collector<Tuple2<String, Long>> out) {

String[] words = value.toLowerCase().split("\\s");

for (String word : words) {

//cassandra的表中,每个word都是主键,因此不能为空

if (!word.isEmpty()) {

out.collect(new Tuple2<String, Long>(word, 1L));

}

}

}

}

)

.keyBy(0)

.timeWindow(Time.seconds(5))

.sum(1);

result.addSink(new PrintSinkFunction<>())

.name("print Sink")

.disableChaining();

CassandraSink.addSink(result)

.setQuery("INSERT INTO example.wordcount(word, count) values (?, ?);")

.setHost("192.168.133.168")

.build()

.name("cassandra Sink")

.disableChaining();

env.execute("kafka-2.4 source, cassandra-3.11.6 sink, tuple2");

}

}

- 上述代码中,从kafka取得数据,做了word count处理后写入到cassandra,注意addSink方法后的一连串API(包含了数据库连接的参数),这是flink官方推荐的操作,另外为了在Flink web UI看清楚DAG情况,这里调用disableChaining方法取消了operator chain,生产环境中这一行可以去掉;

- 编码完成后,执行mvn clean package -U -DskipTests构建,在target目录得到文件flinksinkdemo-1.0-SNAPSHOT.jar;

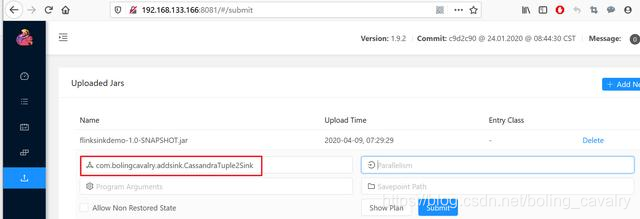

- 在Flink的web UI上传flinksinkdemo-1.0-SNAPSHOT.jar,并指定执行类,如下图红框所示:

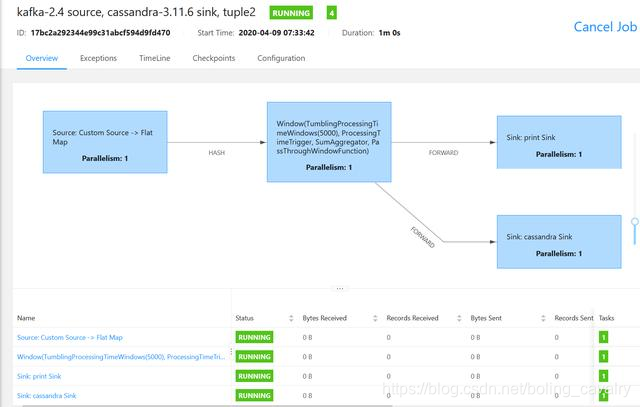

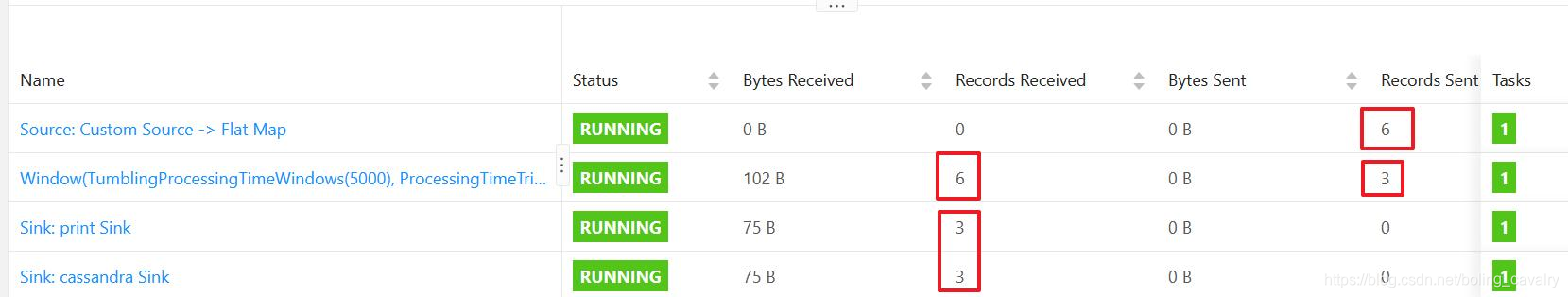

- 启动任务后DAG如下:

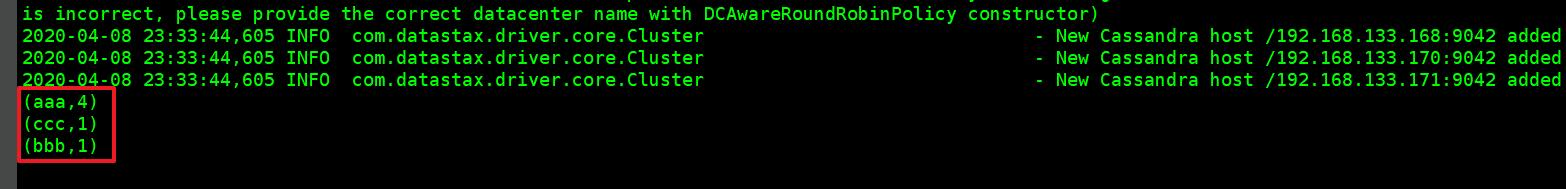

- 去前面创建的发送kafka消息的会话模式窗口,发送一个字符串"aaa bbb ccc aaa aaa aaa";

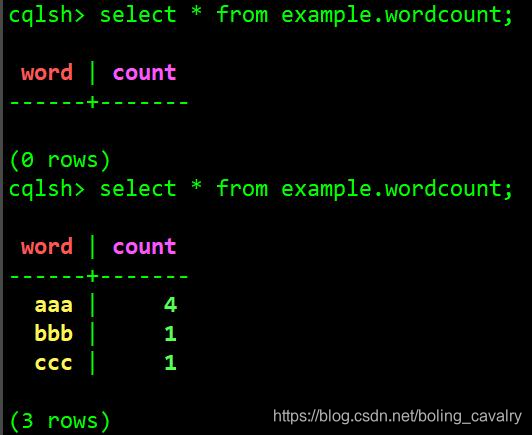

- 查看cassandra数据,发现已经新增了三条记录,内容符合预期:

- 查看TaskManager控制台输出,里面有Tuple2数据集的打印结果,和cassandra的一致:

- DAG上所有SubTask的记录数也符合预期:

开发(POJO写入)

接下来尝试POJO写入,即业务逻辑中的数据结构实例被写入cassandra,无需指定SQL:

- 实现POJO写入数据库,需要datastax库的支持,在pom.xml中增加以下依赖:

<dependency>

<groupId>com.datastax.cassandra</groupId>

<artifactId>cassandra-driver-core</artifactId>

<version>3.1.4</version>

<classifier>shaded</classifier>

<!-- Because the shaded JAR uses the original POM, you still need

to exclude this dependency explicitly: -->

<exclusions>

<exclusion>

<groupId>io.netty</groupId>

<artifactId>*</artifactId>

</exclusion>

</exclusions>

</dependency>

- 请注意上面配置的exclusions节点,依赖datastax的时候,按照官方指导对netty相关的间接依赖做排除,官方地址:https://docs.datastax.com/en/developer/java-driver/3.1/manual/shaded_jar/

- 创建带有数据库相关注解的实体类WordCount:

package com.bolingcavalry.addsink;

import com.datastax.driver.mapping.annotations.Column;

import com.datastax.driver.mapping.annotations.Table;

@Table(keyspace = "example", name = "wordcount")

public class WordCount {

@Column(name = "word")

private String word = "";

@Column(name = "count")

private long count = 0;

public WordCount() {

}

public WordCount(String word, long count) {

this.setWord(word);

this.setCount(count);

}

public String getWord() {

return word;

}

public void setWord(String word) {

this.word = word;

}

public long getCount() {

return count;

}

public void setCount(long count) {

this.count = count;

}

@Override

public String toString() {

return getWord() + " : " + getCount();

}

}

- 然后创建任务类CassandraPojoSink:

package com.bolingcavalry.addsink;

import com.datastax.driver.mapping.Mapper;

import com.datastax.shaded.netty.util.Recycler;

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.api.common.functions.ReduceFunction;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.functions.sink.PrintSinkFunction;

import org.apache.flink.streaming.api.windowing.time.Time;

import org.apache.flink.streaming.connectors.cassandra.CassandraSink;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaConsumer;

import org.apache.flink.util.Collector;

import java.util.Properties;

public class CassandraPojoSink {

public static void main(String[] args) throws Exception {

final StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

//设置并行度

env.setParallelism(1);

//连接kafka用到的属性对象

Properties properties = new Properties();

//broker地址

properties.setProperty("bootstrap.servers", "192.168.50.43:9092");

//zookeeper地址

properties.setProperty("zookeeper.connect", "192.168.50.43:2181");

//消费者的groupId

properties.setProperty("group.id", "flink-connector");

//实例化Consumer类

FlinkKafkaConsumer<String> flinkKafkaConsumer = new FlinkKafkaConsumer<>(

"test001",

new SimpleStringSchema(),

properties

);

//指定从最新位置开始消费,相当于放弃历史消息

flinkKafkaConsumer.setStartFromLatest();

//通过addSource方法得到DataSource

DataStream<String> dataStream = env.addSource(flinkKafkaConsumer);

DataStream<WordCount> result = dataStream

.flatMap(new FlatMapFunction<String, WordCount>() {

@Override

public void flatMap(String s, Collector<WordCount> collector) throws Exception {

String[] words = s.toLowerCase().split("\\s");

for (String word : words) {

if (!word.isEmpty()) {

//cassandra的表中,每个word都是主键,因此不能为空

collector.collect(new WordCount(word, 1L));

}

}

}

})

.keyBy("word")

.timeWindow(Time.seconds(5))

.reduce(new ReduceFunction<WordCount>() {

@Override

public WordCount reduce(WordCount wordCount, WordCount t1) throws Exception {

return new WordCount(wordCount.getWord(), wordCount.getCount() + t1.getCount());

}

});

result.addSink(new PrintSinkFunction<>())

.name("print Sink")

.disableChaining();

CassandraSink.addSink(result)

.setHost("192.168.133.168")

.setMapperOptions(() -> new Mapper.Option[] {

Mapper.Option.saveNullFields(true) })

.build()

.name("cassandra Sink")

.disableChaining();

env.execute("kafka-2.4 source, cassandra-3.11.6 sink, pojo");

}

}

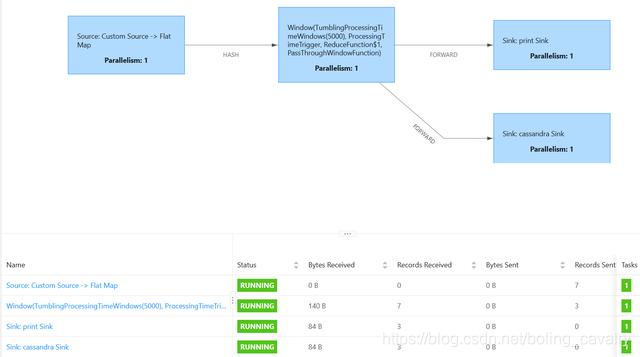

- 从上述代码可见,和前面的Tuple写入类型有很大差别,为了准备好POJO类型的数据集,除了flatMap的匿名类入参要改写,还要写好reduce方法的匿名类入参,并且还要调用setMapperOptions设置映射规则;

- 编译构建后,上传jar到flink,并且指定任务类为CassandraPojoSink:

- 清理之前的数据,在cassandra的cqlsh上执行TRUNCATE example.wordcount;

- 像之前那样发送字符串消息到kafka:

- 查看数据库,发现结果符合预期:

- DAG和SubTask情况如下:

至此,flink的结果数据写入cassandra的实战就完成了,希望能给您一些参考;

智能推荐

Qt核心机制与原理_qt原理-程序员宅基地

文章浏览阅读3.8k次,点赞5次,收藏39次。★了解Qt和C++的关系★掌握Qt的信号/槽机制的原理和使用方法★了解Qt的元对象系统★掌握Qt的架构★理解Qt的事件模型,掌握其使用的时机信号与槽、元对象系统、事件模型是Qt机制的核心,如果您想要掌握Qt编程,就需要对它们有比较深入的了解。本章重点介绍了信号与槽的基本概念和用法、元对象系统、Qt的事件模型,以及它们在实际使用过程中应注意的一些问题。Qt对标准C++的扩展标准C++对象模型为面向对象编程提供了有效的实时支持,但是它的静态特性在一些领域中表现的不够灵活。事实上,GUI应用程序_qt原理

CC2640R2F BLE5.0 TI-RTOS概述_ti rtos 总中断-程序员宅基地

文章浏览阅读8.2k次,点赞3次,收藏25次。TI-RTOS概述TI-RTOS是CC2640R2F设备上蓝牙低能耗项目的运行环境。TI-RTOS内核是传统SYS/BIOS内核的定制版本,可作为具有驱动程序,同步和调度工具的实时抢占式多线程操作系统。线程模块TI-RTOS内核管理线程执行的四个不同的任务级别,如图21所示。线程模块列表如下图所示,按照优先级降序排列。硬件中断软件中断任务后台空闲功能的空闲任务_ti rtos 总中断

按需引入element-ui找不到.babelrc_项目里面没找的.babelrc文件怎么按需引入elment-程序员宅基地

文章浏览阅读2k次,点赞2次,收藏4次。在开发过程中我们可以通过按需引入的方式引入所需要的组件,以达到减小项目体积的目的:步骤一:使用babel-plugin-component插件。运行命令行npm install babel-plugin-component -D2、修改babel.config.js文件module.exports = { presets: ['@vue/cli-plugin-babel/preset'], plugins: [ [ 'component',_项目里面没找的.babelrc文件怎么按需引入elment

Android VideoView或MediaPlayer 播放视频控制静音和正常音量模式切换_android standardgsyvideoplayer 设置静音播放-程序员宅基地

文章浏览阅读7.9k次,点赞7次,收藏11次。再做闪屏页广告的时候,如果是视频媒体,通常用户都不想听广告到底在播什么。如果是 MediaPlayer 的话设置静音模式mediaPlayer.setVolume(0f, 0f);设置有声模式mediaPlayer.setVolume(1, 1);假如是VideoView呢,MediaPlayer对象是私有成员,没办法直接获取到,咋办videoView.setOn..._android standardgsyvideoplayer 设置静音播放

JAVA8按一属性分组统计数量,JDK8:Lambda根据 单个字段、多个字段,分组求和-程序员宅基地

文章浏览阅读8.2k次,点赞2次,收藏3次。使用lambda表达式分别 根据 单个字段、多个字段,分组求和示意图:1、根据 单个字段,分组求和:根据2019这个字段,计算一个list集合里,同属于2019的某个字段累加和2、根据 多个字段,分组求和:(1)先根据2019这个字段,再根据1这个字段,计算一个list集合里,同属于2019和1的某个字段累加和;(2)先根据2019这个字段,再根据2这个字段,计算一个list集合里,同属于2019..._jdk8分组求和

双十一,站在巨人的肩膀上囤最优秀的编程书_编程屯书癖-程序员宅基地

文章浏览阅读6.9k次,点赞58次,收藏526次。双十一,囤点什么书呢?小编想了想,新书?经典书?畅销书?感觉似乎每一类都值得推荐 。每一年出版社的专业新书上百本,如何在适宜的时间选您需要的好书?双十一就是一个很好的时间选择。让小编带你浏览本年度最值得推荐的双十一好书。经典书必备(思维修炼必备)1、编程珠玑(第2版)本书是计算机科学方面的经典名著。书的内容围绕程序设计人员面对的一系列实际问题展开。作者Jon Bentley 以其独有的洞察力和创造力,引导读者理解这些问题并学会解决方法,而这些正是程序员实际编程生涯中至关重要的。本书的特._编程屯书癖

随便推点

webpack打包时如何修改文件名_webpack打包文件名称设置-程序员宅基地

文章浏览阅读5k次。webpack打包时如何修改文件名在使用webpack进行项目打包的时候,我们可通过以下方式对不同类型的资源,进行文件名或文件路径的修改_webpack打包文件名称设置

android mvvm databinding在dialog中的使用_android dialog中使用datebinding-程序员宅基地

文章浏览阅读5.7k次。自定义dialog/** * Created by zhaoxiaoyu on 2019/10/31 0031. */public class CardDialog extends Dialog{ private DialogCardBinding cardBinding; private CardViewModel cardViewModel; private int num; public CardDialog(@NonNull Context context_android dialog中使用datebinding

零基础搭建服务器(DELL PowerEdge R740)_r740安装server2016-程序员宅基地

文章浏览阅读6.3w次,点赞18次,收藏78次。零基础搭建服务器(型号:DELL PowerEdge R740)step1:开机按Ctrl+R删除默认的磁盘组step2:创建虚拟磁盘step3:选择RAID5,分三个硬盘(raid-5最少需要三个),VD-size我给100G用来装系统注意有时候是现实TB如下图step4:再分个盘,用来存储数据把身下的几T都给它,直接OK就行。step5:创建热盘,选中OK,按ESC回车保存退..._r740安装server2016

数据库专业人士“采访”整理记录_访谈数据库的构建以及资料整理-程序员宅基地

文章浏览阅读950次。最近在学后台,数据表设计设计就懵了,感觉并不知道如何设计,于是在QQ上问了公司的专业人士——数据库工程师。感觉学到很多,但因为用的还不够,知识上还是匮乏阶段,所以先整理记录,慢慢消化。 问:大神,问下数据库结构如下,在实际设计中会不会使用外键呢?还是单纯使用逻辑让数据保持一致? 答:独立表,像你列举的公司表,部门表这种相互关系并不大的,一般不会用外键。有外键会影响表的删除_访谈数据库的构建以及资料整理

软件服务工程课程总结_服务工程和服务计算-程序员宅基地

文章浏览阅读5.7k次。第一周云计算什么是云计算云计算是一种模式,该模式允许用户通过无所不在的、便捷的、按需获得的网络,接入到一个可动态配置的共享计算资源池(其中包括网络设备、服务器、存储、应用以及业务),并且以最小的管理代价或业务交互复杂度即可实现这些可配置计算资源的快速发放与发布。Saas软件即服务面临的挑战和它的适用性挑战一:转换成本高。解决方案是提升服务质量,增强客户满意度。挑战二:有限的..._服务工程和服务计算

树莓派使用 OLED 屏显示图片及文字_树莓派如何让0.96oled显示终端命令-程序员宅基地

文章浏览阅读1.8k次。本文所使用的是 128×64 尺寸的屏幕(0.96寸oled),它的接口很简单,只有 4 个 Pin 脚:VCC,GND,SDA,SCL,所以它与树莓派的连接也很简单,如下图所示(本文使用树莓派 3B)开启 I2C 接口树莓派默认是不开启 I2C 接口的,所以我们需要手动打开它。执行以下命令:sudo apt-get install -y python-smbussudo apt-get install -y i2c-toolssudo raspi-config然后按下动图方式开启 I2C _树莓派如何让0.96oled显示终端命令