Hadoop 自定义序列化编程_1.package tem_com; 2.import java.io.ioexception; 3-程序员宅基地

package com.cakin.hadoop.mr;

import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

import org.apache.hadoop.io.WritableComparable;

public class UserWritable implements WritableComparable<UserWritable> {

private Integer id;

private Integer income;

private Integer expenses;

private Integer sum;

public void write(DataOutput out) throws IOException {

// TODO Auto-generated method stub

out.writeInt(id);

out.writeInt(income);

out.writeInt(expenses);

out.writeInt(sum);

}

public void readFields(DataInput in) throws IOException {

// TODO Auto-generated method stub

this.id=in.readInt();

this.income=in.readInt();

this.expenses=in.readInt();

this.sum=in.readInt();

}

public Integer getId() {

return id;

}

public UserWritable setId(Integer id) {

this.id = id;

return this;

}

public Integer getIncome() {

return income;

}

public UserWritable setIncome(Integer income) {

this.income = income;

return this;

}

public Integer getExpenses() {

return expenses;

}

public UserWritable setExpenses(Integer expenses) {

this.expenses = expenses;

return this;

}

public Integer getSum() {

return sum;

}

public UserWritable setSum(Integer sum) {

this.sum = sum;

return this;

}

public int compareTo(UserWritable o) {

// TODO Auto-generated method stub

return this.id>o.getId()?1:-1;

}

@Override

public String toString() {

return id + "\t"+income+"\t"+expenses+"\t"+sum;

}

}package com.cakin.hadoop.mr;

import java.io.IOException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.mapreduce.Reducer;

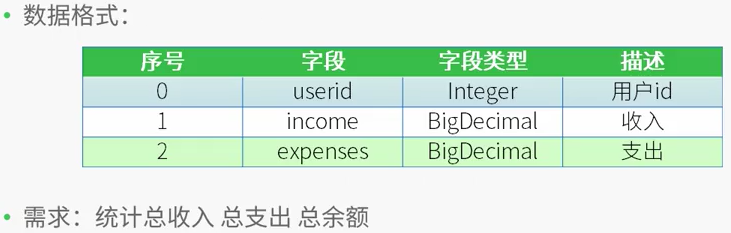

/*

* 测试数据

* 用户id 收入 支出

* 1 1000 0

* 2 500 300

* 1 2000 1000

* 2 500 200

*

* 需求:

* 用户id 总收入 总支出 总的余额

* 1 3000 1000 2000

* 2 1000 500 500

* */

public class CountMapReduce {

public static class CountMapper extends Mapper<LongWritable,Text,IntWritable,UserWritable>

{

private UserWritable userWritable =new UserWritable();

private IntWritable id =new IntWritable();

@Override

protected void map(LongWritable key,Text value,

Mapper<LongWritable,Text,IntWritable,UserWritable>.Context context) throws IOException, InterruptedException{

String line = value.toString();

String[] words = line.split("\t");

if(words.length ==3)

{

userWritable.setId(Integer.parseInt(words[0]))

.setIncome(Integer.parseInt(words[1]))

.setExpenses(Integer.parseInt(words[2]))

.setSum(Integer.parseInt(words[1])-Integer.parseInt(words[2]));

id.set(Integer.parseInt(words[0]));

}

context.write(id, userWritable);

}

}

public static class CountReducer extends Reducer<IntWritable,UserWritable,UserWritable,NullWritable>

{

/*

* 输入数据

* <1,{[1,1000,0,1000],[1,2000,1000,1000]}>

* <2,[2,500,300,200],[2,500,200,300]>

*

* */

private UserWritable userWritable = new UserWritable();

private NullWritable n = NullWritable.get();

protected void reduce(IntWritable key,Iterable<UserWritable> values,

Reducer<IntWritable,UserWritable,UserWritable,NullWritable>.Context context) throws IOException, InterruptedException{

Integer income=0;

Integer expenses = 0;

Integer sum =0;

for(UserWritable u:values)

{

income += u.getIncome();

expenses+=u.getExpenses();

}

sum = income - expenses;

userWritable.setId(key.get())

.setIncome(income)

.setExpenses(expenses)

.setSum(sum);

context.write(userWritable, n);

}

}

public static void main(String[] args) throws IllegalArgumentException, IOException, ClassNotFoundException, InterruptedException {

Configuration conf=new Configuration();

/*

* 集群中节点都有配置文件

conf.set("mapreduce.framework.name.", "yarn");

conf.set("yarn.resourcemanager.hostname", "mini1");

*/

Job job=Job.getInstance(conf,"countMR");

//jar包在哪里,现在在客户端,传递参数

//任意运行,类加载器知道这个类的路径,就可以知道jar包所在的本地路径

job.setJarByClass(CountMapReduce.class);

//指定本业务job要使用的mapper/Reducer业务类

job.setMapperClass(CountMapper.class);

job.setReducerClass(CountReducer.class);

//指定mapper输出数据的kv类型

job.setMapOutputKeyClass(IntWritable.class);

job.setMapOutputValueClass(UserWritable.class);

//指定最终输出的数据kv类型

job.setOutputKeyClass(UserWritable.class);

job.setOutputKeyClass(NullWritable.class);

//指定job的输入原始文件所在目录

FileInputFormat.setInputPaths(job, new Path(args[0]));

//指定job的输出结果所在目录

FileOutputFormat.setOutputPath(job, new Path(args[1]));

//将job中配置的相关参数及job所用的java类在的jar包,提交给yarn去运行

//提交之后,此时客户端代码就执行完毕,退出

//job.submit();

//等集群返回结果在退出

boolean res=job.waitForCompletion(true);

System.exit(res?0:1);

//类似于shell中的$?

}

}[root@centos hadoop-2.7.4]# bin/hdfs dfs -cat /input/data

1 1000 0

2 500 300

1 2000 1000

2 500 200[root@centos hadoop-2.7.4]# bin/yarn jar /root/jar/mapreduce.jar /input/data /output3

17/12/20 21:24:45 INFO client.RMProxy: Connecting to ResourceManager at /0.0.0.0:8032

17/12/20 21:24:46 WARN mapreduce.JobResourceUploader: Hadoop command-line option parsing not performed. Implement the Tool interface and execute your application with ToolRunner to remedy this.

17/12/20 21:24:47 INFO input.FileInputFormat: Total input paths to process : 1

17/12/20 21:24:47 INFO mapreduce.JobSubmitter: number of splits:1

17/12/20 21:24:47 INFO mapreduce.JobSubmitter: Submitting tokens for job: job_1513775596077_0001

17/12/20 21:24:49 INFO impl.YarnClientImpl: Submitted application application_1513775596077_0001

17/12/20 21:24:49 INFO mapreduce.Job: The url to track the job: http://centos:8088/proxy/application_1513775596077_0001/

17/12/20 21:24:49 INFO mapreduce.Job: Running job: job_1513775596077_0001

17/12/20 21:25:13 INFO mapreduce.Job: Job job_1513775596077_0001 running in uber mode : false

17/12/20 21:25:13 INFO mapreduce.Job: map 0% reduce 0%

17/12/20 21:25:38 INFO mapreduce.Job: map 100% reduce 0%

17/12/20 21:25:54 INFO mapreduce.Job: map 100% reduce 100%

17/12/20 21:25:56 INFO mapreduce.Job: Job job_1513775596077_0001 completed successfully

17/12/20 21:25:57 INFO mapreduce.Job: Counters: 49

File System Counters

FILE: Number of bytes read=94

FILE: Number of bytes written=241391

FILE: Number of read operations=0

FILE: Number of large read operations=0

FILE: Number of write operations=0

HDFS: Number of bytes read=135

HDFS: Number of bytes written=32

HDFS: Number of read operations=6

HDFS: Number of large read operations=0

HDFS: Number of write operations=2

Job Counters

Launched map tasks=1

Launched reduce tasks=1

Data-local map tasks=1

Total time spent by all maps in occupied slots (ms)=23672

Total time spent by all reduces in occupied slots (ms)=11815

Total time spent by all map tasks (ms)=23672

Total time spent by all reduce tasks (ms)=11815

Total vcore-milliseconds taken by all map tasks=23672

Total vcore-milliseconds taken by all reduce tasks=11815

Total megabyte-milliseconds taken by all map tasks=24240128

Total megabyte-milliseconds taken by all reduce tasks=12098560

Map-Reduce Framework

Map input records=4

Map output records=4

Map output bytes=80

Map output materialized bytes=94

Input split bytes=94

Combine input records=0

Combine output records=0

Reduce input groups=2

Reduce shuffle bytes=94

Reduce input records=4

Reduce output records=2

Spilled Records=8

Shuffled Maps =1

Failed Shuffles=0

Merged Map outputs=1

GC time elapsed (ms)=157

CPU time spent (ms)=1090

Physical memory (bytes) snapshot=275660800

Virtual memory (bytes) snapshot=4160692224

Total committed heap usage (bytes)=139264000

Shuffle Errors

BAD_ID=0

CONNECTION=0

IO_ERROR=0

WRONG_LENGTH=0

WRONG_MAP=0

WRONG_REDUCE=0

File Input Format Counters

Bytes Read=41

File Output Format Counters

Bytes Written=32[root@centos hadoop-2.7.4]# bin/hdfs dfs -cat /output3/part-r-00000

1 3000 1000 2000

2 1000 500 500智能推荐

hive使用适用场景_大数据入门:Hive应用场景-程序员宅基地

文章浏览阅读5.8k次。在大数据的发展当中,大数据技术生态的组件,也在不断地拓展开来,而其中的Hive组件,作为Hadoop的数据仓库工具,可以实现对Hadoop集群当中的大规模数据进行相应的数据处理。今天我们的大数据入门分享,就主要来讲讲,Hive应用场景。关于Hive,首先需要明确的一点就是,Hive并非数据库,Hive所提供的数据存储、查询和分析功能,本质上来说,并非传统数据库所提供的存储、查询、分析功能。Hive..._hive应用场景

zblog采集-织梦全自动采集插件-织梦免费采集插件_zblog 网页采集插件-程序员宅基地

文章浏览阅读496次。Zblog是由Zblog开发团队开发的一款小巧而强大的基于Asp和PHP平台的开源程序,但是插件市场上的Zblog采集插件,没有一款能打的,要么就是没有SEO文章内容处理,要么就是功能单一。很少有适合SEO站长的Zblog采集。人们都知道Zblog采集接口都是对Zblog采集不熟悉的人做的,很多人采取模拟登陆的方法进行发布文章,也有很多人直接操作数据库发布文章,然而这些都或多或少的产生各种问题,发布速度慢、文章内容未经严格过滤,导致安全性问题、不能发Tag、不能自动创建分类等。但是使用Zblog采._zblog 网页采集插件

Flink学习四:提交Flink运行job_flink定时运行job-程序员宅基地

文章浏览阅读2.4k次,点赞2次,收藏2次。restUI页面提交1.1 添加上传jar包1.2 提交任务job1.3 查看提交的任务2. 命令行提交./flink-1.9.3/bin/flink run -c com.qu.wc.StreamWordCount -p 2 FlinkTutorial-1.0-SNAPSHOT.jar3. 命令行查看正在运行的job./flink-1.9.3/bin/flink list4. 命令行查看所有job./flink-1.9.3/bin/flink list --all._flink定时运行job

STM32-LED闪烁项目总结_嵌入式stm32闪烁led实验总结-程序员宅基地

文章浏览阅读1k次,点赞2次,收藏6次。这个项目是基于STM32的LED闪烁项目,主要目的是让学习者熟悉STM32的基本操作和编程方法。在这个项目中,我们将使用STM32作为控制器,通过对GPIO口的控制实现LED灯的闪烁。这个STM32 LED闪烁的项目是一个非常简单的入门项目,但它可以帮助学习者熟悉STM32的编程方法和GPIO口的使用。在这个项目中,我们通过对GPIO口的控制实现了LED灯的闪烁。LED闪烁是STM32入门课程的基础操作之一,它旨在教学生如何使用STM32开发板控制LED灯的闪烁。_嵌入式stm32闪烁led实验总结

Debezium安装部署和将服务托管到systemctl-程序员宅基地

文章浏览阅读63次。本文介绍了安装和部署Debezium的详细步骤,并演示了如何将Debezium服务托管到systemctl以进行方便的管理。本文将详细介绍如何安装和部署Debezium,并将其服务托管到systemctl。解压缩后,将得到一个名为"debezium"的目录,其中包含Debezium的二进制文件和其他必要的资源。注意替换"ExecStart"中的"/path/to/debezium"为实际的Debezium目录路径。接下来,需要下载Debezium的压缩包,并将其解压到所需的目录。

Android 控制屏幕唤醒常亮或熄灭_android实现拿起手机亮屏-程序员宅基地

文章浏览阅读4.4k次。需求:在诗词曲文项目中,诗词整篇朗读的时候,文章没有读完会因为屏幕熄灭停止朗读。要求:在文章没有朗读完毕之前屏幕常亮,读完以后屏幕常亮关闭;1.权限配置:设置电源管理的权限。

随便推点

目标检测简介-程序员宅基地

文章浏览阅读2.3k次。目标检测简介、评估标准、经典算法_目标检测

记SQL server安装后无法连接127.0.0.1解决方法_sqlserver 127 0 01 无法连接-程序员宅基地

文章浏览阅读6.3k次,点赞4次,收藏9次。实训时需要安装SQL server2008 R所以我上网上找了一个.exe 的安装包链接:https://pan.baidu.com/s/1_FkhB8XJy3Js_rFADhdtmA提取码:ztki注:解压后1.04G安装时Microsoft需下载.NET,更新安装后会自动安装如下:点击第一个傻瓜式安装,唯一注意的是在修改路径的时候如下不可修改:到安装实例的时候就可以修改啦数据..._sqlserver 127 0 01 无法连接

js 获取对象的所有key值,用来遍历_js 遍历对象的key-程序员宅基地

文章浏览阅读7.4k次。1. Object.keys(item); 获取到了key之后就可以遍历的时候直接使用这个进行遍历所有的key跟valuevar infoItem={ name:'xiaowu', age:'18',}//的出来的keys就是[name,age]var keys=Object.keys(infoItem);2. 通常用于以下实力中 <div *ngFor="let item of keys"> <div>{{item}}.._js 遍历对象的key

粒子群算法(PSO)求解路径规划_粒子群算法路径规划-程序员宅基地

文章浏览阅读2.2w次,点赞51次,收藏310次。粒子群算法求解路径规划路径规划问题描述 给定环境信息,如果该环境内有障碍物,寻求起始点到目标点的最短路径, 并且路径不能与障碍物相交,如图 1.1.1 所示。1.2 粒子群算法求解1.2.1 求解思路 粒子群优化算法(PSO),粒子群中的每一个粒子都代表一个问题的可能解, 通过粒子个体的简单行为,群体内的信息交互实现问题求解的智能性。 在路径规划中,我们将每一条路径规划为一个粒子,每个粒子群群有 n 个粒 子,即有 n 条路径,同时,每个粒子又有 m 个染色体,即中间过渡点的_粒子群算法路径规划

量化评价:稳健的业绩评价指标_rar 海龟-程序员宅基地

文章浏览阅读353次。所谓稳健的评估指标,是指在评估的过程中数据的轻微变化并不会显著的影响一个统计指标。而不稳健的评估指标则相反,在对交易系统进行回测时,参数值的轻微变化会带来不稳健指标的大幅变化。对于不稳健的评估指标,任何对数据有影响的因素都会对测试结果产生过大的影响,这很容易导致数据过拟合。_rar 海龟

IAP在ARM Cortex-M3微控制器实现原理_value line devices connectivity line devices-程序员宅基地

文章浏览阅读607次,点赞2次,收藏7次。–基于STM32F103ZET6的UART通讯实现一、什么是IAP,为什么要IAPIAP即为In Application Programming(在应用中编程),一般情况下,以STM32F10x系列芯片为主控制器的设备在出厂时就已经使用J-Link仿真器将应用代码烧录了,如果在设备使用过程中需要进行应用代码的更换、升级等操作的话,则可能需要将设备返回原厂并拆解出来再使用J-Link重新烧录代码,这就增加了很多不必要的麻烦。站在用户的角度来说,就是能让用户自己来更换设备里边的代码程序而厂家这边只需要提供给_value line devices connectivity line devices