”bert“ 的搜索结果

BERT

标签: JupyterNotebook

BERT

本课件是对论文 BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding 的导读与NLP领域经典预训练模型 Bert 的详解,通过介绍NLP领域对通用语言模型的需求,引入 Bert 模型,并对其...

本文章不是模型微调,是从零构架大模型,是基于Bert架构的。 本文主要分两块,一个是tokenizer的构建。二是模型的构建和训练

Django是一个开放源代码的Web应用框架,由Python写成。采用了MVC的软件设计模式,即模型M,视图V和控制器C。用于创建模型的对象关系映射为最终用户设计的完美管理界面一流的 URL 设计设计者友好的模板语言缓存系统。...

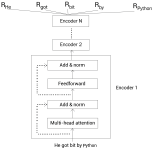

BERT(Bidirectional Encoder Representations from Transformers)是一种预训练模型,它是自然语言处理(NLP)领域的重大里程碑,被认为是当前的State-of-the-Art模型之一。BERT的设计理念和结构基于Transformer...

综上所述,BERT作为自然语言处理领域的重要技术之一,具有广泛的应用前景和巨大的发展潜力。随着技术的不断进步和应用场景的不断拓展,我们有理由相信BERT将在未来发挥更加重要的作用。

hugging-face是访问BERT模型的最初网站,但是目前hugging-face在中国多地不可达,在代码中涉及到该网站的模型都会报错,本文我们就以bert-base-chinese报错为例,提供一个下载到本地的方法来解决问题。

BERT详解:概念、原理与应用

在pytorch上实现了bert模型,并且实现了预训练参数加载功能,可以加载huggingface上的预训练模型参数。 主要包含以下内容: 1) 实现BertEmbeddings、Transformer、BerPooler等Bert模型所需子模块代码。 2) 在子模块...

1、内容概要:本资源主要基于bert(keras)实现文本分类,适用于初学者学习文本分类使用。 2、数据集为电商真实商品评论数据,主要包括训练集data_train,测试集data_test ,经过预处理的训练集clean_data_train和...

文本匹配是指计算机系统识别和确定两段文本之间关系的任务。这个概念非常广泛,涵盖了各种场景,其中文本之间的关系可以是有相似度、问答、对话、推理等。在不同的应用场景下,文本匹配的具体定义可能会有所不同。...

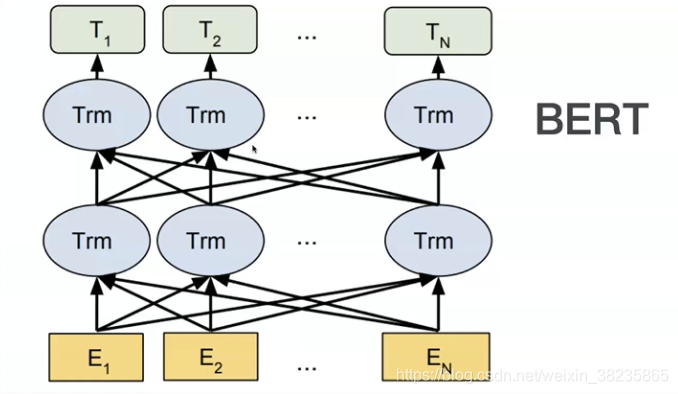

上图就是bert利用了transforemr的编码器结构,从最底层的结构可以看出,E2为原始的单词输入,最中输出的的E2对应的embedding向量T2其实已经综合考虑了上下文信息,因为在神经网络(编码器)内部,信息是交叉,而且特别...

Fast-Bert是一个深度学习库,允许开发人员和数据科学家针对基于文本分类的自然语言处理任务训练和部署基于BERT和XLNet的模型。 FastBert的工作建立在优秀的提供的坚实基础上,并受到启发,并致力于为广大的机器...

在Pyrotch上实现情感分类模型,包含一个BERT 模型和一个分类器(MLP),两者间有一个dropout层。BERT模型实现了预训练参数加载功能,预训练的参数使用HuggingFace的bert_base_uncased模型。同时在代码中实现了基于预...

-XLNet:超越BERT的新星 1.背景介绍 1.1 自然语言处理的重要性 自然语言处理(Natural Language Processing, NLP)是人工智能领域的一个重要分支,旨在使计算机能够理解和生成人类语言。随着大数据时

交互式BERT在医药电商搜索相关性中的探索共14页.pdf.zip

BERT-pytorch

标签: Python

伯特·比托奇 Google AI的2018 BERT的Pytorch实现,带有简单注释BERT 2018 BERT:用于语言理解的深度双向变压器的预培训论文URL: : 介绍Google AI的BERT论文显示了在各种NLP任务(新的17个NLP任务SOTA)上的惊人...

BERT的对抗性嵌入 上基于BERT的情感分类对抗嵌入生成与分析。 建立在对Google Research之上。 IMDB加载器和处理器功能取自。 存储库还包括一种算法,用于投影对抗性嵌入内容以获得对抗性离散文本候选对象。 尽管该...

BERT使用的是transformer的encoder,双向,专注于完形填空。对于缺失的内容和应试内容比较擅长。 GPT使用的是transformer的decoder,单向,专注于预测,因为decoder看不到后面的字符,训练GPT的预测性能。 BERT和GPT...

使用说明保存预训练模型在数据文件夹下├──数据│├──bert_config.json │├──config.json │├──pytorch_model.bin │└──vocab.txt ├──bert_corrector.py ├──config.py ├──logger.py ├──...

https://huggingface.co/google-bert/bert-base-uncased pytorch和tensorflow都有

Bert

https://huggingface.co/google-bert/bert-base-chinese pytorch和tensorflow都有

我们已经证明,除了BERT-Base和BERT-Large之外,标准BERT配方(包括模型体系结构和训练目标)对多种模型尺寸均有效。 较小的BERT模型适用于计算资源有限的环境。 可以按照与原始BERT模型相同的方式对它们进行微调。...

推荐文章

- SINS/GNSS组合导航仿真应用详细版(基于PSINS工具箱 )_psins中gps时间设置-程序员宅基地

- 最火照片墙前端纯HTML(只需添加照片)_照片墙html-程序员宅基地

- Hibernate学习笔记(五)—— Hibernate查询方式-程序员宅基地

- C# 三种用控制台从键盘获取输入的方法_c#获取键盘输入-程序员宅基地

- 基于Vue2的图书销售网站(HTML+CSS+JS)_vue期末作业购物网站-程序员宅基地

- spring-搭建web项目_spring搭建web项目-程序员宅基地

- ROS安装过程sudo rosdep init+rosdep update出现错误:'The read operation timed out'_error: no data sources in /etc/ros/rosdep/sources.-程序员宅基地

- ls路由算法_计算机网络之链路状态路由选择算法(LS)-程序员宅基地

- 个人永久性免费-Excel催化剂功能第59波-快速调用Windows内部常用工具命令-程序员宅基地

- leetcode 509.斐波那契数 C语言 动态规划_动态规划求解斐波那契数列c语言-程序员宅基地