”transformer“ 的搜索结果

Transformer 在之前的章节中,我们已经介绍了主流的神经网络架构如卷积神经网络(CNNs)和循环神经网络(RNNs)。让我们进行一些回顾: CNNs 易于并行化,却不适合捕捉变长序列内的依赖关系。 RNNs 适合捕捉长距离...

使用Pytorch实现Attention is all you need

Google及其研究人员,特别是Ashish Vaswani等人对Transformer模型的贡献,是整个人工智能领域共同进步和发展的重要一环。他们的工作不仅极大地推动了自然语言处理技术的发展,也促进了人工智能在更广泛领域中的应用...

Transformer模型的提出,标志着从序列处理的角度进入了一个新的时代,它使模型能够更加高效地处理和理解语言。他的这一成就不仅推动了NLP技术的进步,也为后续的研究者和开发者提供了新的工具和思路,极大地扩展了...

transformer

标签: Kotlin

transformer

Transformer 模型的实现(最初来自 )应用于时间序列(由提供支持)。 变压器型号 Transformer 是基于注意力的神经网络,旨在解决 NLP 任务。 它们的主要特点是: 特征向量维度的线性复杂度; 序列计算的并行化,...

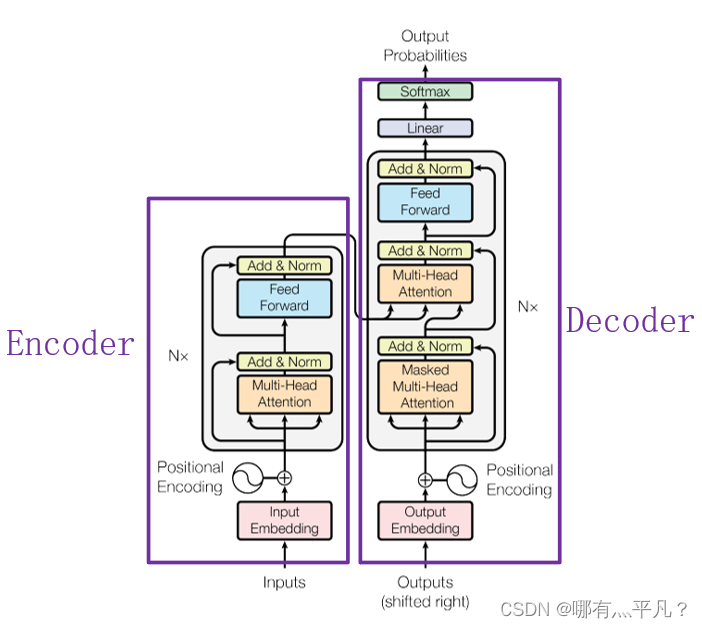

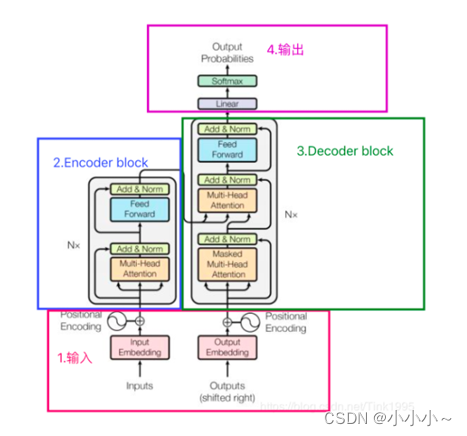

Transformer可以说是深度学习领域最重要的,里程碑式的工作之一,发表于2017年的NIPS。该模型开创了自MLP(多层感知机)、CNN(卷积神经网络)和RNN(循环神经网络)之后的第四种基础模型。这项工作也成为当前AIGC...

Transformer神经网络架构的整体指南

多头注意力机制是transformer的主要创新点,它摒弃了传统卷积神经网络和神经网络的思想,通过 Scaled Dot-Product Attention实现了信息交互,但一次性使用scle dot attention对计算机计算和信息交互而言效果并不好,...

一文带你学会encoder-decoder框架

1.Transformer背景介绍 2.Transfromer整体架构 3.Transformer输入部分 4.Transfromer的编码器 5.Transfromer的解码器 6.Transformer输出部分 7.Transfromer其他部分 1.GPT-1 和 Bert 2.GPT-2 3.GPT-3 Transformer在...

基于TCN-Transformer模型的时间序列预测(Python完整源码),可以用于做光伏发电功率预测,风速预测,风力发电功率预测,负荷预测等,python程序 python代码,pytorch 基于TCN-Transformer模型的时间序列预测...

什么是 Transformer 模型以及它们如何工作?

Transformer是谷歌在2017年的论文《Attention Is All You Need》中提出的,用于NLP的各项任务,现在是谷歌云TPU推荐的参考模型。网上有关Transformer原理的介绍很多,在本文中我们将尽量模型简化,让普通读者也能...

transformer强大到什么程度呢,基本是17年之后绝大部分有影响力模型的基础架构都基于的transformer(比如,有200来个,包括且不限于基于decode的GPT、基于encode的BERT、基于encode-decode的T5等等)通过博客内的这篇...

【Transformer系列】深入浅出理解Transformer网络模型(综合篇)

本例提取了植物幼苗数据集中的部分数据做数据集,数据集共有12种类别,演示如何使用timm版本的Swin Transformer图像分类模型实现分类任务已经对验证集得分的统计,本文实现了多个GPU并行训练。 通过本文你和学到: ...

Swin Transformer 实现图像分类完整代码,拿走即用,路径都是相对路径不用改,自带预训练权重和数据集,不懂可以交流,随随便便参加比赛项目,毕业设计等。

Transformer 是由多层的多头自注意力模块堆叠而成的神经网络模型。原始的 Transformer 模型由编码器和解码器两个部分构成,而这两个部分实际上可以独立使用,例如基于编码器架构的 BERT 模型和解码器架构的 GPT 模型...

在图像获取和传输过程中,往往,降低了图像质量和对图像信息的准确解释,一些老照片因为保存不当也会变得存在污渍或者破损缺失。图像修复技术主要用来修复日常生活中被噪声污染或者人为破坏的破损图像,也可应用于。...

之前的文章好多人蹲代码 这就上传了

ViT的全文翻译,结构同原文保持一致。 1.全文翻译的markdown原文件 2.全文翻译的PDF 3..ViT的原文 4.知识点总结的博客http://t.csdn.cn/PLzkf 逐字逐句翻译Vision in Transformer

本文介绍了一种称为Swin Transformer的新型视觉变形金刚,它可以用作计算机视觉的通用骨干。 在两个领域之间的差异,例如视觉实体规模的巨大差异以及与文字中的单词相比,图像中像素的高分辨率,带来了使...

在本章中,我们将深入探讨网络的开始和结束阶段发生的情况,我将花大量时间回顾一些重要的背景知识,这些知识是熟悉Transformer的机器学习工程师的基础知识。如果你已经熟悉背景知识,迫不及待地想了解更多,你可以跳到下...

Generative Pre-trained Transformer (生成式预训练Transformer)GPT 是 Generative Pre-trained Transformer 的缩写。前面的词比较直白,它们是指能生成新文本的机器人。"Pre-trained"指的是模型已经经历了从大量数据...

推荐文章

- c语言课程图书信息管理系统,c语言课程设图书信息管理系统.doc-程序员宅基地

- webpack4脚手架搭建1——打包并编译es6_webpack编译es6语法打包-程序员宅基地

- 信息通信服务、电子商务及物流服务的创新与发展_信息通信,电子商务-程序员宅基地

- websocket.js的封装,包含保活机制,通用_websocket保活-程序员宅基地

- Ubuntu安装conda-程序员宅基地

- LoadRunner性能测试关注指标及结果分析_loadrunner性能指标分析-程序员宅基地

- java怎么做图形界面_java怎么做图形界面?实例分享-程序员宅基地

- eMMC常识性介绍N_emmc温升系数-程序员宅基地

- MATLAB算法实战应用案例精讲-【人工智能】机器视觉(概念篇)(最终篇)-程序员宅基地

- Mac电脑如何串流游戏 Mac上的CrossOver是串流游戏吗 串流游戏是什么意思 串流游戏怎么玩 Mac电脑怎么玩Steam游戏_macos steam和crossover steam区别-程序员宅基地